Anthropic میگوید هوش مصنوعی (AI) به یک آستانه محوری در امنیت سایبری رسیده است، با شواهد جدیدی که نشان میدهد مدلهای AI اکنون قادر به انجام عملیات بزرگ سایبری—هم دفاعی و هم تهاجمی—در مقیاس بیسابقهای هستند.

آنتروپیک هشدار میدهد که موانع حملات سایبری فروپاشیدهاند با توجه به اینکه قابلیتهای هوش مصنوعی تسریع میشود

Anthropic در تحقیقات جدید خود هشدار میدهد، AI نقطه عطفی در امنیت سایبری رسیده است

Anthropic، شرکت AI پشت Claude، اعلام میکند ارزیابیهای داخلی و کارهای اطلاعاتی تهدیدی آنها نشان از یک تغییر قاطع در توسعه قابلیتهای سایبری دارد. طبق یک تحقیق منتشر شده اخیر، قابلیتهای سایبری در میان سیستمهای AI در شش ماه دو برابر شدهاند، با پشتیبانی از اندازهگیریهای فعالیتهای دنیای واقعی و آزمایش مبتنی بر مدل.

این شرکت میگوید AI اکنون به طور معناداری بر دینامیک امنیت جهانی تأثیر میگذارد، به ویژه در حالی که بازیگران مخرب به طور فزایندهای چارچوبهای حمله خودکار را به کار میگیرند. در آخرین گزارش خود، Anthropic جزئیات آنچه که بهعنوان اولین مورد مستند از یک کمپین جاسوسی سایبری هماهنگشده توسط AI نامیده میشود، ارائه میکند. تیم اطلاعاتی تهدیدی این شرکت در میانه سپتامبر ۲۰۲۵، عملیاتی بزرگمقیاس را که به یک گروه چینی تحتحمایت دولت به نام GTG-1002 نسبت داده شد، شناسایی و مختل کرد.

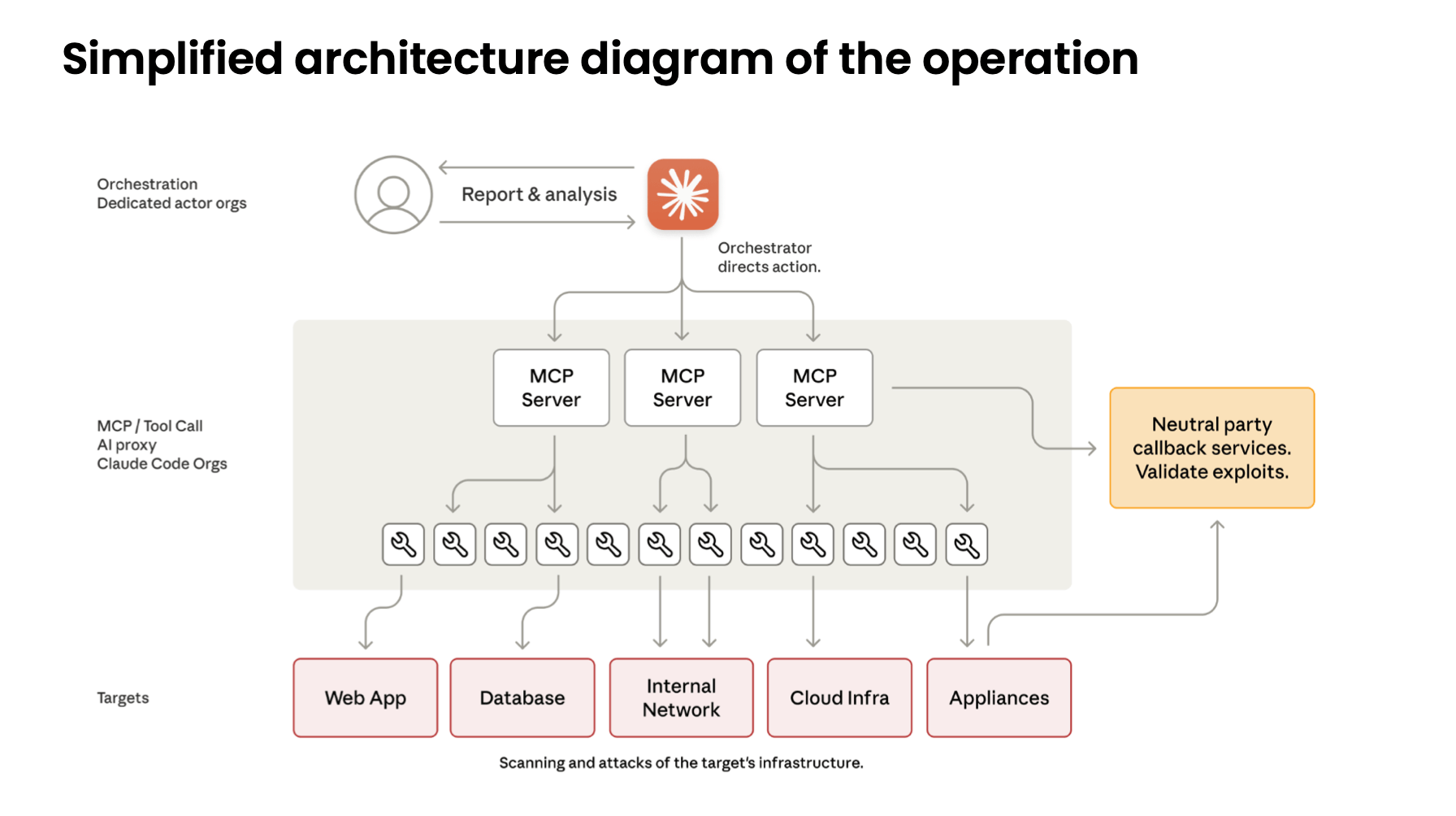

گزارشها حاکی از آنند که این گروه از موارد هماهنگشده Claude Code برای انجام شناسایی، کشف آسیبپذیری، بهرهبرداری، حرکت جانبی، استخراج متاداده و تخلیه دادهها—بهصورت عمده بدون دخالت انسان—استفاده کردند. این کمپین حدود ۳۰ سازمان در بخشهایی از جمله فناوری، امور مالی، شیمی و چندین نهاد دولتی را هدف قرار داد. Anthropic چندین نفوذ موفق را قبل از مداخله تأیید کرد.

تحلیلگران میگویند مهاجمان از یک چارچوب خودکار که قادر به خردکردن حملات چندمرحلهای به وظایف کوچکتری که در هنگام جداسازی از متن وسیعتر خود مشروع به نظر میرسیدند، استفاده کردند. این به بازیگران اجازه داد تا از طریق پرسوناهای موجود دستورات را منتقل کرده و Claude را متقاعد کنند که عملیات دفاعی است و نه عملیات تهاجمی.

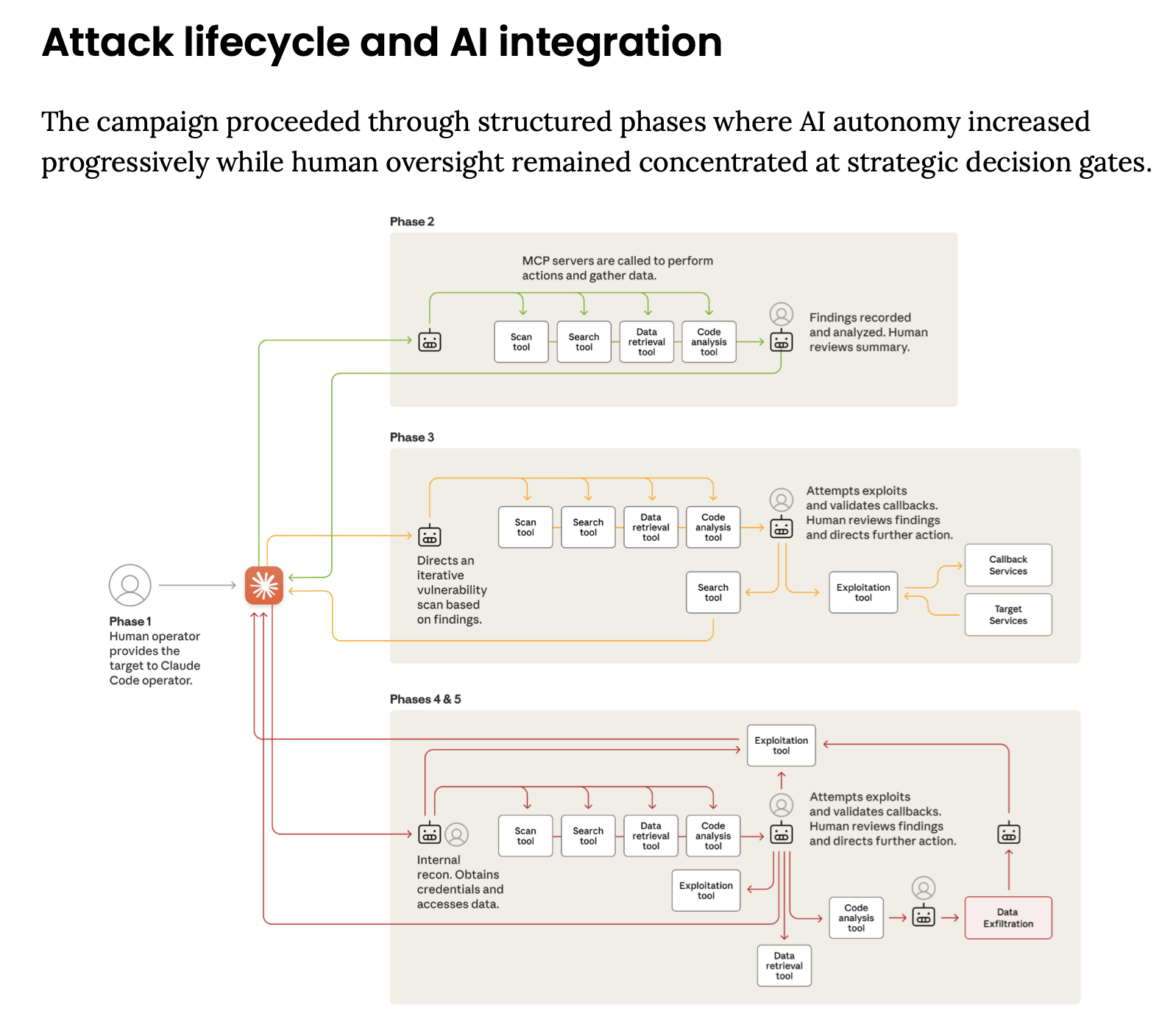

طبق تحقیقات، Claude بهطور خودکار بین ۸۰٪ تا ۹۰٪ از عملیاتهای تاکتیکی را اجرا کرد. اپراتورهای انسانی تنها نظارت استراتژیک را ارائه دادند، در حالی که مراحل اصلی مانند ارتقای عملیات از شناسایی به بهرهبرداری فعال یا مجاز کردن تخلیه دادهها را تأیید کردند. گزارش سطحی از سرعت عملیات را توصیف میکند که برای تیمهای تنها انسانی غیرممکن است، با برخی جریانات کاری که عملیاتهای متعددی را در ثانیه در هزاران درخواست ایجاد میکند.

Anthropic میگوید چرخه عمر حمله از طریق یک خط لوله ساختاریافته پیشرفت کرد که در هر مرحله خودمختاری AI افزایش یافت. Claude بهطور مستقل سطوح حمله را نقشهبرداری کرد، سیستمهای زنده را اسکن کرد، بارهای سفارشی برای آسیبپذیریهای تایید شده ساخت، اعتبارات را برداشت و از طریق شبکههای داخلی انتقال کرد. همچنین دادههای سرقتشده را تحلیل کرد، اطلاعات با ارزش بالا را شناسایی و بهطور خودکار مستندات عملیاتی دقیق تولید کرد که دسترسی مستمر و انتقالات بین اپراتورها را فعال میکرد.

یکی از محدودیتها، گزارشی است که به تمایل مدل به توهم تحت بارهای کاری تهاجمی اشاره میکند—بهطور گاه و بیگاه دسترسی را بیش از واقع توصیف کرده، اعتبارات ساخته یا اطلاعات عمومی را بهعنوان حساس نادرست معرفی کرده است. با این حال، Anthropic میگوید بازیگر از طریق مراحل تاییدی جبران کرد، نشان داد که عملیاتهای تهاجمی کاملاً خودمختار علیرغم نقصها در مدلهای امروزی همچنان ممکن است.

پس از کشف، Anthropic حسابهای مربوطه را ممنوع کرد، به نهادهای تحتتأثیر اطلاع داد، با مقامات همکاری کرد، و مکانیسمهای دفاعی جدیدی، از جمله طبقهبندیکنندههای بهبود یافته برای شناسایی الگوهای تهدیدی جدید معرفی کرد. این شرکت اکنون سیستمهای هشدار اولیه را طراحی میکند که تلاشهای نفوذ خودکار را پرچم میکنند و ابزارهای تحقیقاتی جدید برای عملیاتهای سایبری توزیعشده بزرگمقیاس را میسازد.

بیشتر بخوانید: بازار ‘Magentic’ مایکروسافت نشان میدهد چگونه عوامل AI تحت فشار ممکن است فرو بریزند

این شرکت میگوید در حالی که این قابلیتها میتوانند مورد سوءاستفاده قرار گیرند، به همان اندازه برای تقویت آمادگی دفاعی حیاتی هستند. Anthropic اشاره میکند که تیم اطلاعات تهدیدی خودش به شدت به Claude برای تحلیل مجموعه دادههای بزرگ تولید شده در طول تحقیقات تکیه کرد. این شرکت برای امنیت تیمها توصیه میکند که شروع به پذیرش اتوماسیون مبتنی بر AI برای مراکز عملیات امنیتی، شناسایی تهدید، تحلیل آسیبپذیری، و پاسخ به حوادث کنند.

اما گزارش هشدار میدهد که موانع حملات سایبری بهطور چشمگیری کاهش یافتهاند، زیرا سیستمهای AI اجازه میدهند که گروههای کوچک—یا حتی افراد—عملیاتی را اجرا کنند که قبلاً محدود به بازیگران دولتی با بودجه قوی بود. Anthropic انتظار دارد فناوریهای اینچنینی به سرعت در محیط تهدید گستردهتر شایع شوند و خواهان همکاری عمیقتر، حفاظت دفاعی بهبود یافته و مشارکت گستردهتر صنعتی در اشتراکگذاری تهدید برای مقابله با مدلهای حمله جدید با AI شود.

سؤالات متداول ❓

- Anthropic در تحقیقات خود چه چیزی کشف کرد؟

Anthropic یک کمپین جاسوسی سایبری بزرگمقیاس را که از AI برای خودکارسازی بیشتر عملیاتهای حمله استفاده میکرد، شناسایی و مختل کرد. - چه کسی پشت این حمله بود؟

این شرکت عملیات را به یک گروه چینی تحتحمایت دولت با نام GTG-1002 نسبت داده است. - چگونه از AI در ورودها استفاده شد؟

مهاجمان از Claude Code برای انجام خودکار شناسایی، بهرهبرداری، حرکت جانبی و استخراج داده استفاده کردند. - چرا این گزارش برای تیمهای امنیت سایبری اهمیت دارد؟

Anthropic میگوید این مورد نشان میدهد که حملات خودکار فعالشده توسط AI در مقیاس امکانپذیرند و نیاز به استراتژیهای دفاعی جدیدی دارند.