El secretario de Defensa, Pete Hegseth, se reunió el martes con el director ejecutivo de Anthropic, Dario Amodei, en el Pentágono, mientras el Departamento de Defensa presionaba a Anthropic para que eliminara las restricciones de su sistema de inteligencia artificial (IA) Claude o se enfrentara a posibles sanciones.

Informe: El futuro de la IA Claude de Anthropic es incierto en los sistemas clasificados del Pentágono

La gobernanza de la IA militar se pone a prueba en una reunión de alto riesgo en el Pentágono

La reunión del 24 de febrero se produjo tras semanas de tensión por las políticas de uso de Anthropic para Claude, el gran modelo lingüístico integrado en las redes clasificadas del Departamento de Defensa en virtud de un contrato piloto de 2025 valorado en hasta 200 millones de dólares. Claude es actualmente el único modelo lingüístico de gran tamaño totalmente autorizado que opera en determinados sistemas seguros del Pentágono.

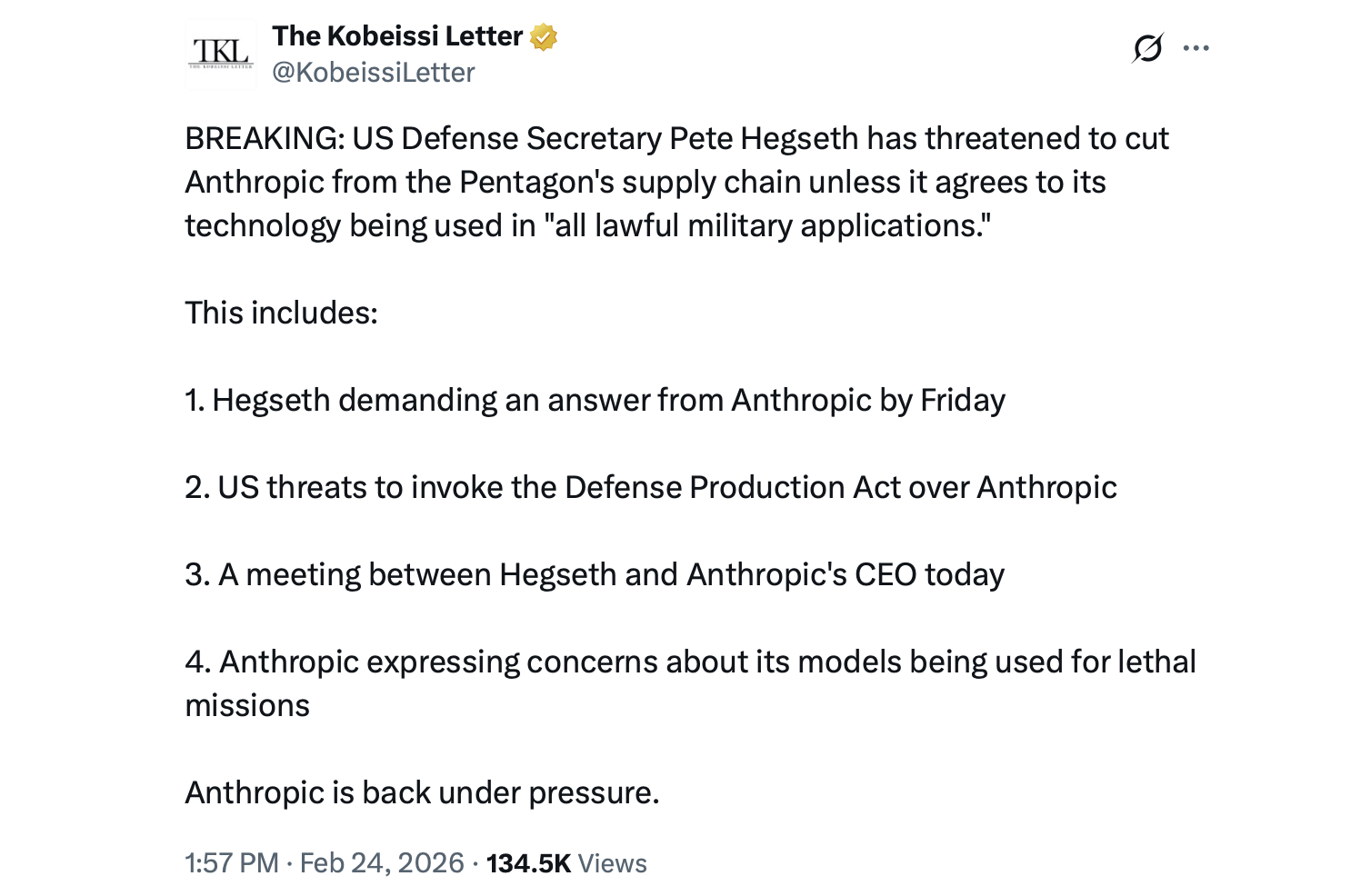

Según informa Axios, Hegseth, acompañado por el subsecretario Steve Feinberg y el consejero general Earl Matthews, se opuso a las restricciones de Anthropic sobre la vigilancia masiva de los estadounidenses y sobre los sistemas de armas totalmente autónomos que operan sin supervisión humana. Los funcionarios de Defensa argumentaron que esos límites restringen las aplicaciones militares legales y no deben prevalecer sobre la autoridad del Congreso y del Ejecutivo.

Anthropic ha mantenido que sus salvaguardias están diseñadas para evitar el uso indebido, al tiempo que permiten aplicaciones de seguridad nacional. La empresa afirma que sus políticas no bloquean el uso militar legítimo, sino que prohíben actividades como el seguimiento de personas sin su consentimiento o el despliegue de sistemas letales sin control humano.

«Según una fuente familiarizada con las conversaciones, Anthropic nunca se ha opuesto al uso de sus modelos para "operaciones militares legítimas"», informó la corresponsal jefe de seguridad nacional de Fox News, Jennifer Griffin, en X. «También le dijo a Hegseth que nunca se quejó al Pentágono ni a Palantir por el uso de sus modelos en la incursión contra Maduro».

Claude se ha utilizado para el análisis de inteligencia, la ciberdefensa y la planificación operativa. Los informes indican que apoyó la planificación y el análisis en tiempo real durante la operación del 3 de enero que dio lugar a la captura del presidente venezolano Nicolás Maduro. Posteriormente, Anthropic solicitó una aclaración sobre la participación del modelo como parte de una revisión interna de cumplimiento, lo que los funcionarios del Pentágono interpretaron como una crítica.

El 9 de enero, Hegseth emitió un memorándum en el que instaba a los proveedores de inteligencia artificial (IA) a eliminar lo que él describía como condiciones restrictivas. Esa directiva sentó las bases para las renegociaciones y, en última instancia, para la reunión del 24 de febrero.

El Pentágono ha fijado el 27 de febrero como fecha límite para que Anthropic modifique sus condiciones. Las posibles respuestas incluyen invocar la Ley de Producción de Defensa para obligar al cumplimiento o designar a Anthropic como un riesgo para la cadena de suministro, una medida que podría obligar a los contratistas a desprenderse de los sistemas relacionados con Claude.

Los funcionarios reconocen que separar a Claude de la infraestructura existente sería operativamente complejo. Aun así, el departamento tiene alternativas. Competidores como xAI con su modelo Grok, OpenAI con ChatGPT y Google con Gemini tienen contratos similares con el Departamento de Defensa y podrían estar en condiciones de ampliar sus funciones si las negociaciones fracasan. La disputa pone de relieve cuestiones más amplias sobre la gobernanza de la IA en el ámbito militar, especialmente ahora que la legislación federal sigue evolucionando en torno a las tecnologías emergentes. Lo que está en juego es si los desarrolladores privados de IA pueden mantener políticas éticas independientes cuando sus sistemas se integran en las operaciones de seguridad nacional.

La reacción en las redes sociales ha sido notablemente sincera. «Vuelve la vigilancia sin orden judicial», escribió un usuario de X en respuesta a la publicación de Griffin en X. «Esto debería ser una noticia mucho más importante de lo que es. Existe un riesgo grave de violaciones constitucionales», respondió otro en el artículo de Griffin. Otros, con una dosis de humor negro, bromearon diciendo que la llegada de Skynet podría no estar muy lejos. «Skynet está aquí… la línea temporal de 2029 está EN VIVO», comentó la persona. Ambas partes han calificado el debate del 24 de febrero como sustantivo. El hecho de que Anthropic ajuste sus medidas de seguridad antes de la fecha límite podría determinar el futuro de una de las integraciones de IA más avanzadas del Pentágono.

Preguntas frecuentes 🤖

- ¿Qué se discutió en la reunión del Pentágono del 24 de febrero? La reunión se centró en las restricciones de Anthropic a la IA Claude y en si estas limitan las aplicaciones militares legales.

- ¿Por qué presiona el Pentágono a Anthropic? Los responsables de Defensa argumentan que las medidas de seguridad de la empresa interfieren con los usos autorizados para la seguridad nacional.

- ¿Qué podría pasar si Anthropic no cumple? El Pentágono podría invocar la Ley de Producción de Defensa o designar a la empresa como un riesgo para la cadena de suministro.

- ¿Existen alternativas a Claude? Sí, los modelos de xAI, OpenAI y Google están bajo contrato con el Departamento de Defensa y podrían ampliarse si fuera necesario.