Anthropic ha dado el extraordinario paso de demandar al Gobierno de Estados Unidos después de que el Pentágono calificara a la empresa de inteligencia artificial (IA) como «riesgo para la seguridad nacional en la cadena de suministro», lo que ha desencadenado un enfrentamiento legal que podría cambiar la forma en que Washington controla a los proveedores de inteligencia artificial que trabajan con el ejército.

Anthropic, la empresa de Dario Amodei, demanda al Gobierno de EE. UU. alegando que el Pentágono tomó represalias por las medidas de seguridad en materia de IA.

Anthropic se enfrenta al Departamento de Defensa en una demanda histórica sobre IA

Según varios informes, Anthropic presentó dos demandas el 9 de marzo en un tribunal federal en las que impugnaba las medidas adoptadas por el Departamento de Defensa de Estados Unidos y la administración Trump, argumentando que el Gobierno tomó represalias ilegales contra la empresa después de que esta se negara a eliminar las medidas de seguridad de su sistema de inteligencia artificial Claude. Las demandas se dirigen contra una designación que normalmente se aplica a adversarios extranjeros sospechosos de espionaje o sabotaje, no a empresas tecnológicas nacionales.

La disputa se remonta a las negociaciones contractuales entre Anthropic y el Pentágono sobre cómo las agencias de defensa estadounidenses podrían utilizar el modelo de IA Claude de la empresa. Anthropic había apoyado anteriormente iniciativas de seguridad nacional y se convirtió en la primera empresa de IA de vanguardia en implementar modelos en redes clasificadas del Gobierno de EE. UU. en junio de 2024, ayudando a analistas y planificadores militares con la revisión de inteligencia, simulaciones, planificación operativa y trabajo de ciberseguridad.

Las tensiones se intensificaron cuando el Departamento de Defensa exigió acceso sin restricciones a Claude para «todos los fines legales» como parte de la renovación del contrato. Anthropic aceptó la mayoría de las condiciones, pero insistió en dos restricciones: prohibir el uso de su IA para la vigilancia masiva de los estadounidenses y evitar su implementación en sistemas de armas letales totalmente autónomos.

Los ejecutivos de la empresa argumentaron que esas medidas de protección eran necesarias porque los modelos actuales de IA de vanguardia siguen siendo demasiado poco fiables para las armas autónomas y porque los programas de vigilancia a gran escala podrían entrar en conflicto con las protecciones constitucionales. Anthropic afirmó que las restricciones nunca habían interferido en ninguna misión militar durante su anterior trabajo con el Gobierno.

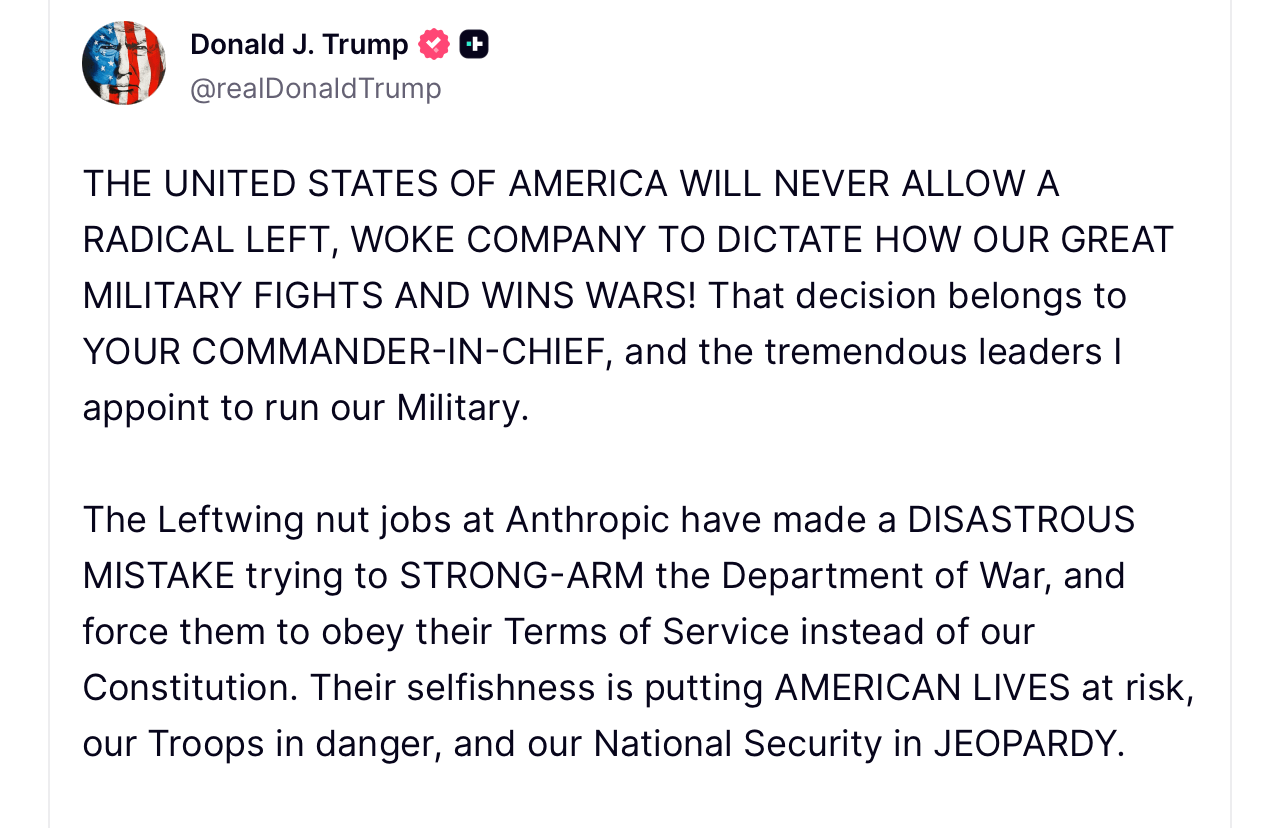

Las negociaciones fracasaron tras una reunión celebrada el 24 de febrero entre el director ejecutivo de Anthropic, Dario Amodei, y el secretario de Defensa, Pete Hegseth. Días más tarde, el 27 de febrero, el presidente Donald Trump publicó en Truth Social una orden a las agencias federales de «cesar inmediatamente» el uso de la tecnología de Anthropic, calificando la continua dependencia de la empresa como un «error desastroso».

Poco después, Hegseth decidió clasificar a Anthropic como un riesgo para la cadena de suministro en virtud de la autoridad federal en materia de contratación pública establecida en el artículo 10 U.S.C. § 3252. La designación, confirmada en una carta enviada a la empresa alrededor del 4 de marzo, restringe a determinados contratistas del Gobierno el uso de tecnología considerada vulnerable al sabotaje o a la influencia extranjera.

Anthropic sostiene que la medida extiende la ley mucho más allá de su propósito original. En los documentos judiciales, la empresa sostiene que la designación estaba destinada a amenazas de seguridad vinculadas al extranjero y no a desacuerdos políticos con proveedores nacionales. Las demandas alegan que el Gobierno no utilizó los «medios menos restrictivos» exigidos por la ley y, en su lugar, impuso lo que la empresa describe como una lista negra no oficial.

Los documentos judiciales también plantean cuestiones constitucionales. Anthropic sostiene que la designación viola la Primera Enmienda al castigar a la empresa por defender públicamente la limitación del uso de la IA en ámbitos como las armas autónomas y la vigilancia interna. Según la demanda, calificar a la empresa de riesgo para la seguridad nacional daña su reputación y podría poner en peligro contratos por valor de cientos de millones de dólares.

Anthropic solicita a los tribunales que bloqueen la aplicación de la designación, ordenen a las agencias federales que retiren las directivas que suspenden los negocios con la empresa y eviten acciones similares en el futuro. La empresa afirma que su objetivo no es obligar al Gobierno a adquirir su tecnología, sino evitar represalias por diferencias políticas. «Solicitar una revisión judicial no cambia nuestro compromiso de larga data de aprovechar la IA para proteger nuestra seguridad nacional», afirmó un portavoz de Anthropic en un comunicado. «Pero es un paso necesario para proteger nuestro negocio, nuestros clientes y nuestros socios». Los funcionarios del Pentágono no han hecho comentarios públicos sobre el litigio, alegando la política relativa a los casos judiciales en curso. Algunos líderes de la defensa han argumentado anteriormente que las agencias militares deben conservar la plena autoridad operativa sobre las tecnologías de los contratistas durante las emergencias y no pueden permitir que los proveedores dicten cómo se utilizan los sistemas.

El fin de semana salvaje de la IA: la reorganización de OpenAI, el enfrentamiento con el Pentágono y los robots que se niegan a morir.

Los cambios en la IA se producen rápidamente: el drama de OpenAI, el enfrentamiento del Pentágono con Anthropic, el lanzamiento de GPT-5.4, los robots con capacidad de autorreparación y las nuevas herramientas de seguridad. read more.

Leer ahora

El fin de semana salvaje de la IA: la reorganización de OpenAI, el enfrentamiento con el Pentágono y los robots que se niegan a morir.

Los cambios en la IA se producen rápidamente: el drama de OpenAI, el enfrentamiento del Pentágono con Anthropic, el lanzamiento de GPT-5.4, los robots con capacidad de autorreparación y las nuevas herramientas de seguridad. read more.

Leer ahora

El fin de semana salvaje de la IA: la reorganización de OpenAI, el enfrentamiento con el Pentágono y los robots que se niegan a morir.

Leer ahoraLos cambios en la IA se producen rápidamente: el drama de OpenAI, el enfrentamiento del Pentágono con Anthropic, el lanzamiento de GPT-5.4, los robots con capacidad de autorreparación y las nuevas herramientas de seguridad. read more.

La disputa llega en un momento en que se intensifica la carrera por conseguir contratos militares de IA. Empresas rivales, entre ellas OpenAI, llegaron a acuerdos con el Pentágono aproximadamente al mismo tiempo que se rompieron las negociaciones con Anthropic. Mientras tanto, importantes socios tecnológicos como Google y Microsoft han indicado que tienen la intención de seguir trabajando con Anthropic en servicios comerciales no relacionados con la defensa.

Los analistas del sector afirman que el resultado del caso podría sentar un precedente sobre cómo el Gobierno federal presiona a las empresas de IA para que modifiquen sus políticas de seguridad cuando están en juego los intereses de la seguridad nacional. Por ahora, los productos de consumo y los servicios comerciales de IA de Anthropic siguen estando disponibles, mientras que la batalla legal sobre la designación del Pentágono comienza a tramitarse en los tribunales.

Preguntas frecuentes 🧭

- ¿Por qué demandó Anthropic al Gobierno de los Estados Unidos? Anthropic presentó demandas alegando que el Pentágono calificó ilegalmente a la empresa como un riesgo para la cadena de suministro de la seguridad nacional después de que esta se negara a eliminar las restricciones de seguridad de la IA.

- ¿Qué desencadenó la disputa entre Anthropic y el Pentágono? El conflicto comenzó durante las negociaciones del contrato, cuando el Departamento de Defensa exigió el uso sin restricciones del sistema de IA Claude de Anthropic.

- ¿Qué significa la designación de «riesgo para la cadena de suministro»? Esta etiqueta puede limitar el uso de la tecnología de una empresa por parte de los contratistas del Gobierno si los funcionarios consideran que supone un riesgo para la seguridad o las adquisiciones.

- ¿Seguirán funcionando los servicios de IA de Anthropic durante el juicio? Sí, los productos comerciales de IA y los servicios al consumidor de Anthropic seguirán estando disponibles mientras se desarrolla el proceso judicial.