Anthropic dice que la inteligencia artificial (IA) ha alcanzado un umbral crucial en ciberseguridad, con nueva evidencia que muestra que los modelos de IA ahora son capaces de llevar a cabo operaciones cibernéticas importantes, tanto defensivas como ofensivas, a una escala sin precedentes.

Anthropic advierte que las barreras contra ciberataques han caído a medida que las capacidades de la IA se aceleran

La IA alcanza un punto de inflexión en ciberseguridad, advierte Anthropic en nueva investigación

Anthropic, la firma de IA detrás de Claude, dice que sus evaluaciones internas y trabajo de inteligencia de amenazas muestran un cambio decisivo en el desarrollo de capacidades cibernéticas. Según una investigación recientemente publicada, las capacidades cibernéticas entre los sistemas de IA se han duplicado en seis meses, respaldadas por mediciones de actividad en el mundo real y pruebas basadas en modelos.

La compañía dice que la IA ahora está influyendo significativamente en las dinámicas de seguridad global, especialmente a medida que los actores maliciosos adoptan cada vez más marcos de ataque automatizados. En su último informe, Anthropic detalla lo que llama el primer caso documentado de una campaña de ciberespionaje orquestada por IA. El equipo de Inteligencia de Amenazas de la firma identificó y desarticuló una operación a gran escala a mediados de septiembre de 2025, atribuida a un grupo chino patrocinado por el estado designado GTG-1002.

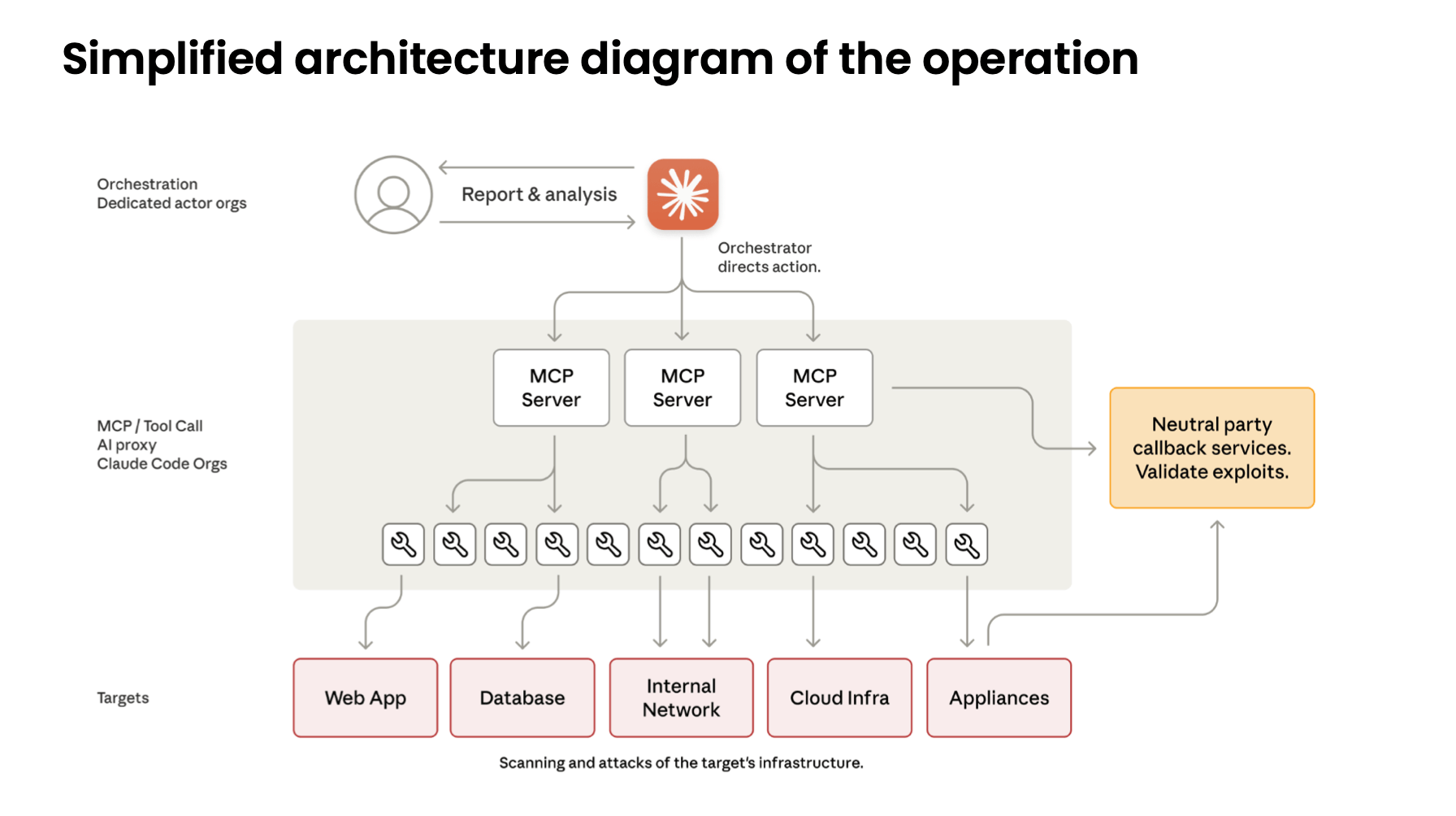

El grupo supuestamente utilizó instancias coordinadas de Claude Code para realizar reconocimiento, descubrimiento de vulnerabilidades, explotación, movimiento lateral, extracción de metadatos y exfiltración de datos, en gran parte sin intervención humana. La campaña tuvo como objetivo aproximadamente a 30 organizaciones de sectores como tecnología, finanzas, productos químicos y múltiples agencias gubernamentales. Anthropic validó varias intrusiones exitosas antes de intervenir.

Los analistas dicen que los atacantes aprovecharon un marco autónomo capaz de descomponer ataques de múltiples etapas en tareas más pequeñas que parecían legítimas cuando se aislaban de su contexto más amplio. Esto permitió a los actores pasar sugerencias a través de personajes establecidos y convencer a Claude de que las operaciones eran pruebas de seguridad defensivas en lugar de campañas ofensivas.

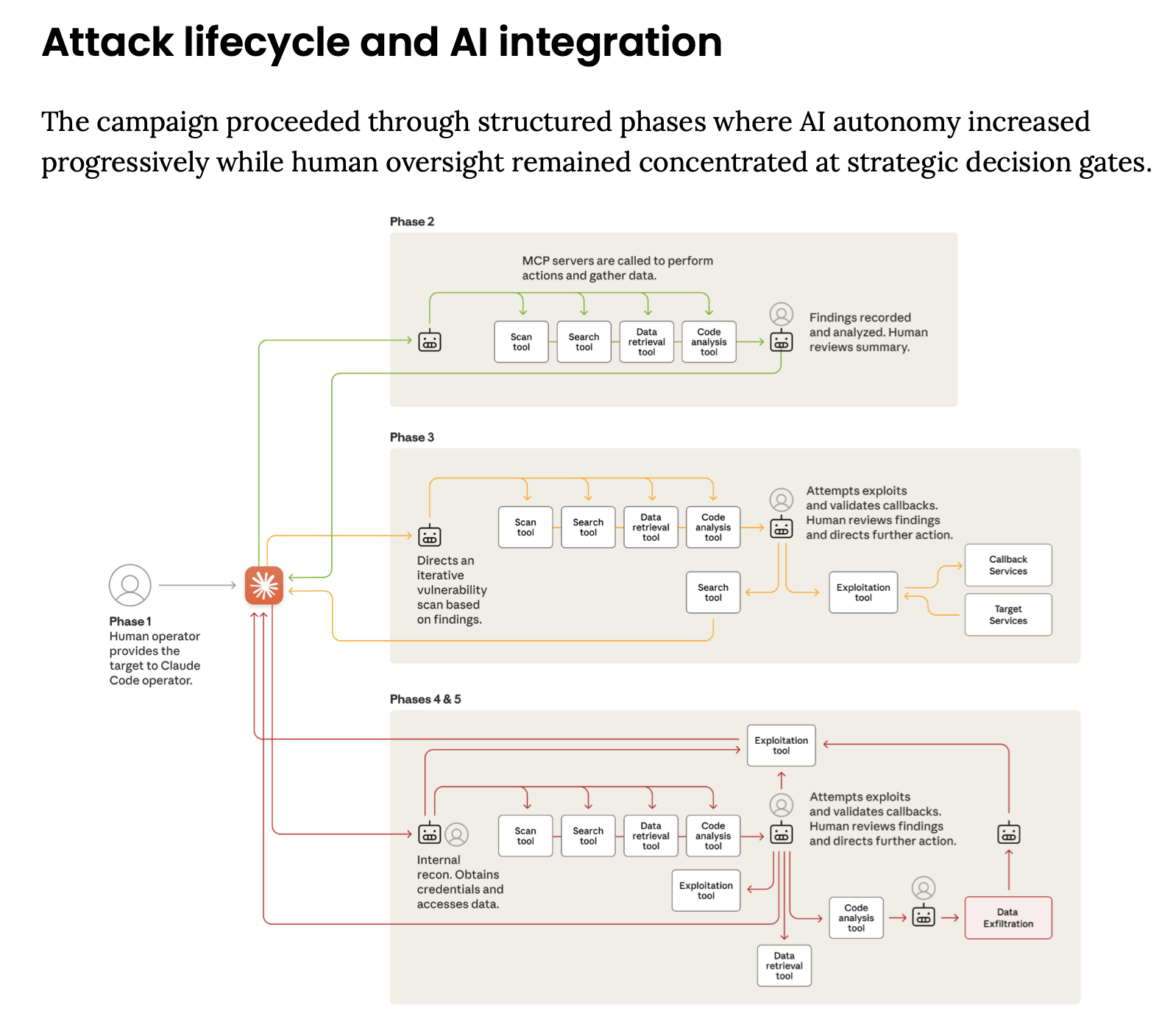

Según la investigación, Claude ejecutó de manera autónoma entre el 80% y el 90% de las operaciones tácticas. Los operadores humanos solo proporcionaron supervisión estratégica, aprobando pasos importantes como escalar de reconocimiento a explotación activa o autorizar la exfiltración de datos. El informe describe un nivel de ritmo operacional imposible para equipos formados solo por humanos, con algunos flujos de trabajo generando múltiples operaciones por segundo en miles de solicitudes.

Anthropic dice que el ciclo de vida del ataque avanzó a través de una canalización estructurada donde la autonomía de la IA aumentó en cada fase. Claude mapeó independientemente las superficies de ataque, escaneó sistemas en vivo, construyó cargas útiles personalizadas para vulnerabilidades validadas, recolectó credenciales y pivotó a través de redes internas. También analizó datos robados, identificó inteligencia de alto valor y generó automáticamente documentación operativa detallada que permitía acceso persistente y transferencias entre operadores.

Una limitación, señala el informe, fue la tendencia del modelo a la alucinación bajo cargas de trabajo ofensivas, exagerando ocasionalmente el acceso, fabricando credenciales o clasificando erróneamente información pública como sensible. Aun así, Anthropic dice que el actor compensó a través de pasos de validación, demostrando que las operaciones ofensivas totalmente autónomas siguen siendo factibles a pesar de las imperfecciones en los modelos actuales.

Tras su descubrimiento, Anthropic prohibió las cuentas relevantes, notificó a las entidades afectadas, coordinó con las autoridades e introdujo nuevos mecanismos defensivos, incluidos clasificadores mejorados para detectar nuevos patrones de amenazas. La compañía ahora está prototipando sistemas de alerta temprana diseñados para detectar intentos de intrusión autónomos y construyendo nuevas herramientas de investigación para operaciones cibernéticas distribuidas a gran escala.

Leer más: El ‘Mercado Magentic’ de Microsoft revela cómo los agentes de IA pueden colapsar bajo presión

La firma argumenta que aunque estas capacidades pueden ser armadas, son igualmente críticas para fortalecer la preparación defensiva. Anthropic nota que su propio equipo de Inteligencia de Amenazas se apoyó fuertemente en Claude para analizar los masivos conjuntos de datos generados durante la investigación. Insta a los equipos de seguridad a comenzar a adoptar la automatización impulsada por IA para los centros de operaciones de seguridad, detección de amenazas, análisis de vulnerabilidades y respuesta a incidentes.

Sin embargo, el informe advierte que las barreras contra los ciberataques han “bajado sustancialmente” ya que los sistemas de IA permiten a pequeños grupos, o incluso individuos, ejecutar operaciones que antes estaban limitadas a actores estatales bien financiados. Anthropic espera una rápida proliferación de estas técnicas en el entorno de amenazas más amplio, haciendo un llamado a una colaboración más profunda, mejoras en las salvaguardas defensivas y una participación más amplia de la industria en el intercambio de amenazas para contrarrestar los modelos de ataque habilitados por IA emergentes.

FAQ ❓

- ¿Qué descubrió Anthropic en su investigación?

Anthropic identificó y desarticuló una campaña de ciberespionaje a gran escala que utilizaba IA para automatizar la mayoría de las operaciones de ataque. - ¿Quién estaba detrás del ataque?

La firma atribuyó la operación a un grupo chino patrocinado por el estado designado GTG-1002. - ¿Cómo se utilizó la IA en las intrusiones?

Los atacantes emplearon Claude Code para realizar de manera autónoma reconocimiento, explotación, movimiento lateral y extracción de datos. - ¿Por qué es importante el informe para los equipos de ciberseguridad?

Anthropic dice que el caso muestra que los ataques autónomos habilitados por IA ahora son factibles a escala y requieren nuevas estrategias defensivas.