Das Wettrüsten im Bereich der künstlichen Intelligenz (KI) hat gerade einen weiteren Schub erhalten, nachdem Nvidia satte 2 Milliarden Dollar in den KI-Cloud-Anbieter Nebius investiert hat. Dies signalisiert, dass der Kampf um die nächste Grenze der Datenverarbeitung nicht allein mit cleverem Code ausgetragen wird – sondern mit Gigawatt an Strom und Lagerhallen voller Silizium.

Nvidia unterstützt die Pläne für die Nebius-KI-Fabrik mit einer massiven Investition in Höhe von 2 Milliarden Dollar

Nvidias KI-Wette: 2-Milliarden-Dollar-Investition zielt auf Rechenzentren im Gigawatt-Maßstab

Nvidia und die Nebius Group gaben diese Woche bekannt, dass der Chip-Riese rund 2 Milliarden Dollar über vorfinanzierte Optionsscheine investieren wird, um sich eine Minderheitsbeteiligung zu sichern und gleichzeitig den Ausbau einer riesigen Hyperscale-KI-Infrastruktur zu finanzieren, deren von Nvidia beschleunigte Rechenkapazität bis 2030 voraussichtlich 5 Gigawatt übersteigen wird.

Fünf Gigawatt sind, um das in einen Zusammenhang zu setzen, keine kleine Zahl für ein Start-up. Das ist die Art von Stromverbrauch, die normalerweise mit Städten in Verbindung gebracht wird, nicht mit Server-Racks. Praktisch gesehen zielt die Partnerschaft darauf ab, riesige KI-„Fabriken“ zu schaffen, die in der Lage sind, große Modelle zu trainieren, Inferenz-Workloads auszuführen und die wachsende Welle agentischer KI-Systeme zu bewältigen, die derzeit den Technologiesektor überschwemmt.

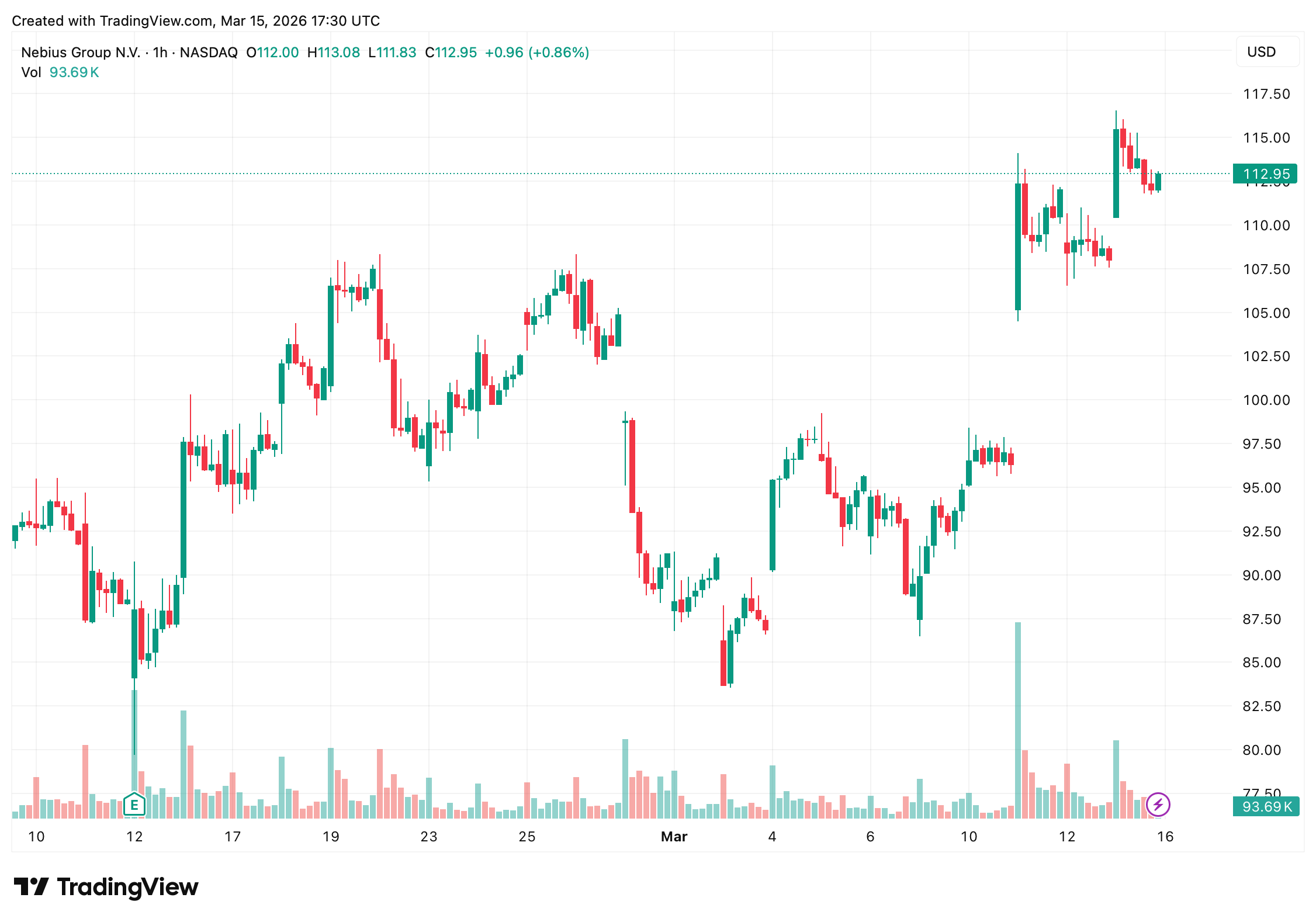

Nebius mit Hauptsitz in Amsterdam, das an der Nasdaq unter dem Tickersymbol NBIS gehandelt wird, ist einer der neueren Marktteilnehmer in der Kategorie, die Analysten mittlerweile als „Neocloud“ bezeichnen – Unternehmen, die speziell für KI-Workloads konzipiert wurden und nicht aus traditionellen Unternehmens-Cloud-Plattformen umgerüstet wurden.

Auch wenn der Name ungewohnt klingt, sind seine Wurzeln es nicht. Nebius entstand 2024, nachdem die niederländische Muttergesellschaft des russischen Suchriesen Yandex ihre russischen Geschäftsbereiche für rund 5,4 Milliarden US-Dollar veräußert hatte. Die verbleibenden internationalen Aktivitäten wurden in Nebius umstrukturiert, das nun KI-Infrastruktur in den Vereinigten Staaten, Europa und Israel betreibt.

Seitdem agiert das Unternehmen mit der stillen Dringlichkeit eines Menschen, der weiß, dass das Buffet bald leer sein wird. Nebius betreibt bereits große GPU-Cluster mit Nvidia-Hardware – darunter H100- und H200-Beschleuniger – und plant im Rahmen der neuen Partnerschaft die Einführung zukünftiger Systeme wie Nvidias Rubin-Architektur, Vera-CPUs und BlueField-Speicherplattformen.

Im Gegenzug sichert sich Nvidia einen wichtigen langfristigen Ökosystempartner, der enorme Mengen seiner Chips abnehmen wird. Man kann sich das als das Hardware-Äquivalent dazu vorstellen, sich einen garantierten Tisch im beliebtesten Restaurant der Stadt zu sichern. Die Unternehmen geben an, dass die Zusammenarbeit den gesamten KI-Technologie-Stack umfasst – vom Entwurf von Rechenzentren über die Bereitstellung von Inferenz-Infrastruktur bis hin zur Verwaltung von GPU-Flotten.

Jensen Huang, Gründer und CEO von Nvidia, stellte die Partnerschaft als Teil der nächsten Phase des KI-Booms dar. „KI befindet sich an einem weiteren Wendepunkt – agentische KI, die einen unglaublichen Rechenbedarf antreibt und den Ausbau der Infrastruktur beschleunigt“, sagte Huang in der gemeinsamen Ankündigung. „Nebius baut eine KI-Cloud auf, die für das agentische Zeitalter konzipiert ist.“

Arkady Volozh, CEO von Nebius und Mitbegründer von Yandex, der das Unternehmen durch seine Wiedergeburt nach der Ausgliederung führte, stellte Nebius als einen der wenigen Cloud-Anbieter vor, der speziell für KI entwickelt wurde und nicht aus bestehenden Computing-Diensten umfunktioniert wurde.

„Nebius wurde von Anfang an für KI entwickelt“, sagte Volozh. „Gemeinsam mit Nvidia erweitern wir dies nun auf den gesamten Stack – von KI-Fabriken im Gigawatt-Maßstab bis hin zu Inferenz und Software.“

Und die Größenordnung, von der hier die Rede ist, ist keineswegs hypothetisch.

Nur wenige Tage vor der Bekanntgabe der Investition erhielt Nebius die Genehmigung für einen 1,2-Gigawatt-KI-Rechenzentrumskomplex in Independence, Missouri – einer der größten geplanten KI-Infrastrukturstandorte in den Vereinigten Staaten. Das Projekt soll rund 1.200 Arbeitsplätze im Baugewerbe schaffen und über zwei Jahrzehnte hinweg einen geschätzten wirtschaftlichen Nutzen von 650 Millionen US-Dollar generieren.

Das Projekt in Missouri ist nur ein Teil einer umfassenderen Expansionsstrategie, in deren Rahmen Nebius bis Ende 2026 bis zu 16 globale Rechenzentrumsstandorte betreiben könnte, wobei die vertraglich vereinbarte Stromkapazität im nächsten Jahr fast 3 Gigawatt erreichen wird.

Es überrascht nicht, dass das Geld in einem Tempo ausgegeben wird, das selbst Risikokapitalgeber aus dem Silicon Valley staunen lassen würde.

Nebius meldete allein für das vierte Quartal 2025 Investitionsausgaben in Höhe von etwa 2,1 Milliarden US-Dollar, und die prognostizierten Ausgaben für 2026 liegen zwischen 16 und 20 Milliarden US-Dollar, da das Unternehmen darum wetteifert, die Infrastruktur aufzubauen, bevor die Nachfrage das Angebot übersteigt.

Der Umsatz bleibt vorerst relativ bescheiden – rund 530 Millionen US-Dollar in den letzten zwölf Monaten –, doch das Unternehmen gibt an, dass langfristige Verträge und der Auftragsbestand auf eine rasche Skalierung hindeuten.

Zu den wichtigsten Geschäften zählen ein mehrjähriger Vertrag mit Microsoft im Zusammenhang mit einem Rechenzentrumsprojekt in Vineland, New Jersey, dessen Wert auf 17 bis 19,4 Milliarden US-Dollar geschätzt wird, sowie eine separate Vereinbarung mit Meta Platforms im Wert von 3 Milliarden US-Dollar.

Den Anlegern gefiel offensichtlich, was sie sahen.

Morgan Stanley warnt: KI ist mittlerweile eine makroökonomische Kraft – und ein Markt für agentische KI im Wert von 139 Milliarden Dollar entsteht

Künstliche Intelligenz (KI) ist längst nicht mehr nur ein Spielzeug für Vorführungen im Silicon Valley – sie entwickelt sich zu einem globalen Industrieprojekt im Wert von Billionen. read more.

Jetzt lesen

Morgan Stanley warnt: KI ist mittlerweile eine makroökonomische Kraft – und ein Markt für agentische KI im Wert von 139 Milliarden Dollar entsteht

Künstliche Intelligenz (KI) ist längst nicht mehr nur ein Spielzeug für Vorführungen im Silicon Valley – sie entwickelt sich zu einem globalen Industrieprojekt im Wert von Billionen. read more.

Jetzt lesen

Morgan Stanley warnt: KI ist mittlerweile eine makroökonomische Kraft – und ein Markt für agentische KI im Wert von 139 Milliarden Dollar entsteht

Jetzt lesenKünstliche Intelligenz (KI) ist längst nicht mehr nur ein Spielzeug für Vorführungen im Silicon Valley – sie entwickelt sich zu einem globalen Industrieprojekt im Wert von Billionen. read more.

Die Nebius-Aktie legte nach Bekanntwerden der Nvidia-Investition um 13 % bis 16 % zu und trieb die Marktkapitalisierung des Unternehmens im frühen Handel über die 24-Milliarden-Dollar-Marke. Analysten bezeichnen solche Partnerschaften oft als „Nvidia-Halo-Effekt“ – eine höfliche Umschreibung dafür, dass die Wall Street bei einem Auftritt des Chipherstellers mit dem Scheckbuch davon ausgeht, dass etwas Interessantes vor sich geht.

Die übergeordnete Botschaft ist unmissverständlich: Künstliche Intelligenz mag auf Algorithmen basieren, doch ihr eigentlicher Engpass ist die Infrastruktur – Strom, Kühlung und genügend fortschrittliche Chips, um die digitalen Gehirne am Laufen zu halten. Und da Nvidia Milliarden-Schecks ausstellt, um das Ökosystem zu erweitern, wird der Wettlauf um den Aufbau des weltweiten KI-Rückgrats nur noch lauter.

FAQ 🤖

- Warum hat Nvidia 2 Milliarden Dollar in Nebius investiert? Nvidia unterstützt Nebius, um eine riesige KI-Cloud-Infrastruktur auszubauen, die große Mengen seiner Chips verbrauchen wird.

- Was ist Nebius und warum ist es für die KI von Bedeutung? Nebius ist ein KI-Cloud-Anbieter der nächsten Generation, der speziell für das Training und den Betrieb großer KI-Systeme entwickelt wurde.

- Was bedeuten 5 Gigawatt KI-Infrastruktur? Das entspricht einer enormen Rechenzentrumskapazität – in etwa dem Stromverbrauch von Millionen von Haushalten, die ausschließlich für den Betrieb von KI-Workloads genutzt werden.

- Warum bauen Unternehmen KI-Rechenzentren im Gigawatt-Maßstab? Die explosionsartige Zunahme von KI-Modellen, Inferenzdiensten und autonomen Agenten erfordert eine beispiellose Rechenleistung und Energie.