Ein dezentrales KI-Experiment, das bislang auf Krypto-Kreise beschränkt war, hat nun öffentliche Anerkennung von Nvidia-CEO Jensen Huang erhalten – ein Zeichen dafür, dass das verteilte Modelltraining sich langsam dem Mainstream annähert.

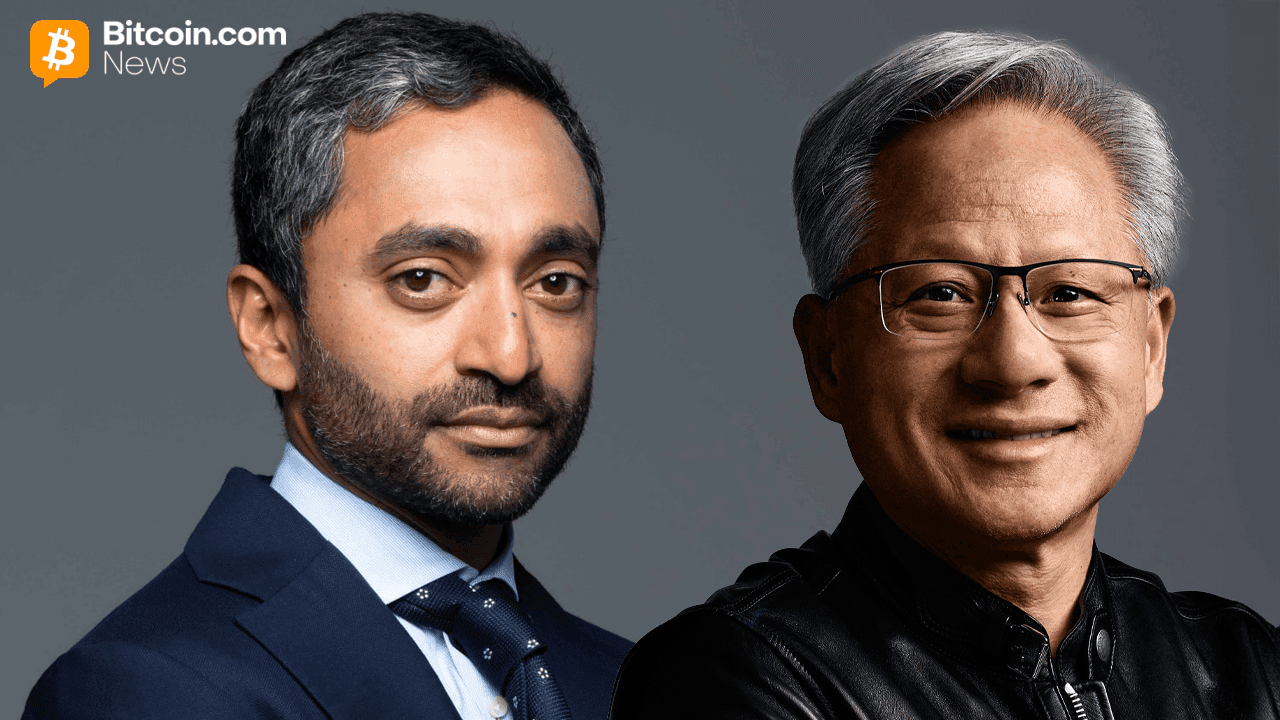

Meilenstein bei der Bittensor-Schulung rückt ins Rampenlicht von Chamath Palihapitiya und Nvidia-CEO Jensen Huang

Open-Source-KI gewinnt mit Unterstützung des Nvidia-CEO an Dynamik

Chamath Palihapitiya stellte Bittensors Covenant-72B in einer Folge des All-In-Podcasts vor und bezeichnete es als konkretes Beispiel für dezentrale künstliche Intelligenz (KI), die über die Theorie hinausgeht. Bittensor funktioniert als dezentrales, Blockchain-basiertes Netzwerk, das einen Peer-to-Peer-Marktplatz schafft, auf dem Modelle für maschinelles Lernen und KI-Rechenleistung ausgetauscht und incentiviert werden.

Palihapitiya beschrieb das Vorhaben in einfachen Worten: ein groß angelegtes Sprachmodell (LLM), das ohne zentralisierte Infrastruktur trainiert wurde und stattdessen von einem Netzwerk unabhängiger Mitwirkender angetrieben wird. „Sie haben es geschafft, ein LLaMA-Modell mit 4 Milliarden Parametern zu trainieren, vollständig dezentralisiert, wobei eine Reihe von Leuten überschüssige Rechenleistung beigesteuert hat“, sagte er und bezeichnete dies als „eine ziemlich verrückte technische Leistung“.

Der Vergleich führte zu einer bekannten Analogie. „Es gibt zufällige Leute, und jede Person erhält einen kleinen Anteil“, fügte Palihapitiya hinzu und bezog sich dabei auf das frühe Projekt zum verteilten Rechnen, das weltweit ungenutzte Hardware nutzte.

Huang wies die Idee nicht zurück. Stattdessen bezog er sich auf einen breiteren Rahmen des KI-Marktes und deutete an, dass dezentrale und proprietäre Ansätze sich nicht gegenseitig ausschließen. „Diese beiden Dinge sind nicht A oder B; es ist A und B“, sagte Huang. „Daran besteht kein Zweifel.“

Diese zweigleisige Vision spiegelt eine wachsende Kluft – und Überschneidung – innerhalb der KI wider. Auf der einen Seite stehen geschlossene, hochpolierte Systeme wie ChatGPT, Claude und Gemini. Auf der anderen Seite stehen offene und dezentrale Modelle, die es Entwicklern und Organisationen ermöglichen, Systeme an spezifische Bedürfnisse anzupassen.

Huang machte deutlich, dass er beide Wege als unverzichtbar ansieht. „Modelle sind eine Technologie, kein Produkt“, sagte er und merkte an, dass die meisten Nutzer weiterhin auf ausgereifte, universell einsetzbare Systeme setzen werden, anstatt ihre eigenen von Grund auf neu zu entwickeln.

Gleichzeitig wies er auf Branchen hin, in denen Anpassung keine Option ist. „Es gibt all diese Branchen, in denen ihr Fachwissen … auf eine Weise erfasst werden muss, die sie kontrollieren können“, erklärte Huang und fügte hinzu: „Das kann nur durch offene Modelle erreicht werden.“

Diese Aussage trifft genau den Kern von Bittensor. Covenant-72B, entwickelt über sein Subnet 3 (Templar), stellt einen der bislang größten dezentralen Trainingsläufe dar und koordiniert mehr als 70 Mitwirkende über Standard-Internetverbindungen ohne zentrale Autorität.

Technisch gesehen setzt das Modell neue Maßstäbe. Es wurde mit 72 Milliarden Parametern erstellt und auf rund 1,1 Billionen Token trainiert und nutzt Innovationen wie komprimierte Kommunikationsprotokolle und verteilte Datenparallelität, um das Training außerhalb traditioneller Rechenzentren zu ermöglichen.

Leistungskennzahlen deuten darauf hin, dass es sich nicht nur um ein Experiment handelt. Benchmark-Ergebnisse stellen es in Konkurrenz zu etablierten zentralisierten Modellen, ein Detail, das erklärt, warum das Projekt auch über das Krypto-Publikum hinaus Aufmerksamkeit erregt hat.

Auch der Markt hat dies zur Kenntnis genommen. Nach der Ankündigung ist der Projekt-Token TAO um 24 % gestiegen, seit das Video von Palihapitiya und Huang in den sozialen Medien die Runde machte.

Nvidia unterstützt die Pläne für die Nebius-KI-Fabrik mit einer massiven Investition in Höhe von 2 Milliarden Dollar

Erfahren Sie, wie Nvidia mit einer Investition von 2 Milliarden Dollar in die KI-Cloud-Infrastruktur die Zukunft der Datenverarbeitung neu gestaltet. read more.

Jetzt lesen

Nvidia unterstützt die Pläne für die Nebius-KI-Fabrik mit einer massiven Investition in Höhe von 2 Milliarden Dollar

Erfahren Sie, wie Nvidia mit einer Investition von 2 Milliarden Dollar in die KI-Cloud-Infrastruktur die Zukunft der Datenverarbeitung neu gestaltet. read more.

Jetzt lesen

Nvidia unterstützt die Pläne für die Nebius-KI-Fabrik mit einer massiven Investition in Höhe von 2 Milliarden Dollar

Jetzt lesenErfahren Sie, wie Nvidia mit einer Investition von 2 Milliarden Dollar in die KI-Cloud-Infrastruktur die Zukunft der Datenverarbeitung neu gestaltet. read more.

Dennoch deuten Huangs Äußerungen darauf hin, dass es nicht um eine Disruption geht, sondern um die Koexistenz beider Modelle. Proprietäre KI-Systeme werden für allgemeine Nutzer wahrscheinlich weiterhin dominieren, während offene und dezentrale Modelle sich in spezialisierten, kostensensiblen oder souveränitätsorientierten Anwendungen etablieren werden.

Für Start-ups skizzierte der Nvidia-CEO einen pragmatischen Fahrplan: offen beginnen, dann proprietäre Vorteile einbauen. „Jedes Start-up, in das wir derzeit investieren, setzt zunächst auf Open Source und wechselt dann zum proprietären Modell“, sagte er.

Mit anderen Worten: Die Zukunft der KI gehört möglicherweise nicht einer einzigen Architektur oder Philosophie. Sie gehört vielleicht denen, die sich in beiden Bereichen zurechtfinden – und wissen, wann sie welche einsetzen müssen.

FAQ 🔎

- Was ist Bittensors Covenant-72B? Ein Sprachmodell mit 72 Milliarden Parametern, das über ein dezentrales Netzwerk von Mitwirkenden ohne zentralisierte Infrastruktur trainiert wurde.

- Was sagte Jensen Huang über dezentrale KI? Er sagte, offene und proprietäre KI-Modelle würden nebeneinander bestehen, und beschrieb die Beziehung als „A und B“, nicht als eine Wahl zwischen beiden.

- Warum ist diese Entwicklung wichtig? Sie zeigt, dass groß angelegte KI-Modelle außerhalb traditioneller Rechenzentren trainiert werden können, was Annahmen über den Infrastrukturbedarf in Frage stellt.

- Wie wirkt sich dies auf die KI-Branche aus? Es unterstützt eine hybride Zukunft, in der zentralisierte Plattformen und dezentrale Modelle branchenübergreifend unterschiedliche Rollen übernehmen.