Anthropic hat den außergewöhnlichen Schritt unternommen, die US-Regierung zu verklagen, nachdem das Pentagon das Unternehmen für künstliche Intelligenz (KI) als „Risiko für die nationale Sicherheit in der Lieferkette“ bezeichnet hatte. Damit hat es einen Rechtsstreit ausgelöst, der die Art und Weise, wie Washington KI-Anbieter kontrolliert, die mit dem Militär zusammenarbeiten, grundlegend verändern könnte.

Dario Amodeis Anthropic verklagt US-Regierung und behauptet, das Pentagon habe wegen Sicherheitsvorkehrungen für KI Vergeltungsmaßnahmen ergriffen

Anthropic verklagt das Verteidigungsministerium in einem wegweisenden KI-Prozess

Mehreren Berichten zufolge reichte Anthropic am 9. März zwei Klagen vor einem Bundesgericht ein, in denen es die Maßnahmen des US-Verteidigungsministeriums und der Trump-Regierung anfocht und argumentierte, die Regierung habe unrechtmäßig gegen das Unternehmen Vergeltungsmaßnahmen ergriffen, nachdem es sich geweigert hatte, Sicherheitsvorkehrungen aus seinem KI-System Claude zu entfernen. Die Klagen richten sich gegen eine Einstufung, die normalerweise für ausländische Gegner gilt, die der Spionage oder Sabotage verdächtigt werden, nicht für inländische Technologieunternehmen.

Der Streit geht auf Vertragsverhandlungen zwischen Anthropic und dem Pentagon darüber zurück, wie das Claude-KI-Modell des Unternehmens von US-Verteidigungsbehörden genutzt werden könnte. Anthropic hatte zuvor nationale Sicherheitsinitiativen unterstützt und war im Juni 2024 das erste KI-Unternehmen, das Modelle in geheimen Netzwerken der US-Regierung einsetzte, um Analysten und Militärplaner bei der Überprüfung von Geheimdienstinformationen, Simulationen, der operativen Planung und der Cybersicherheit zu unterstützen.

Die Spannungen eskalierten, als das Verteidigungsministerium im Rahmen einer Vertragsverlängerung uneingeschränkten Zugang zu Claude für „alle rechtmäßigen Zwecke“ forderte. Anthropic stimmte den meisten Bedingungen zu, bestand jedoch auf zwei Einschränkungen: dem Verbot der Nutzung seiner KI für die Massenüberwachung von US-Bürgern und dem Verbot des Einsatzes in vollautonomen tödlichen Waffensystemen.

Die Führungskräfte des Unternehmens argumentierten, dass diese Schutzmaßnahmen notwendig seien, da die aktuellen KI-Modelle für autonome Waffen noch zu unzuverlässig seien und groß angelegte Überwachungsprogramme im Widerspruch zu verfassungsrechtlichen Schutzbestimmungen stehen könnten. Anthropic erklärte, dass die Einschränkungen während seiner bisherigen Zusammenarbeit mit der Regierung niemals militärische Missionen beeinträchtigt hätten.

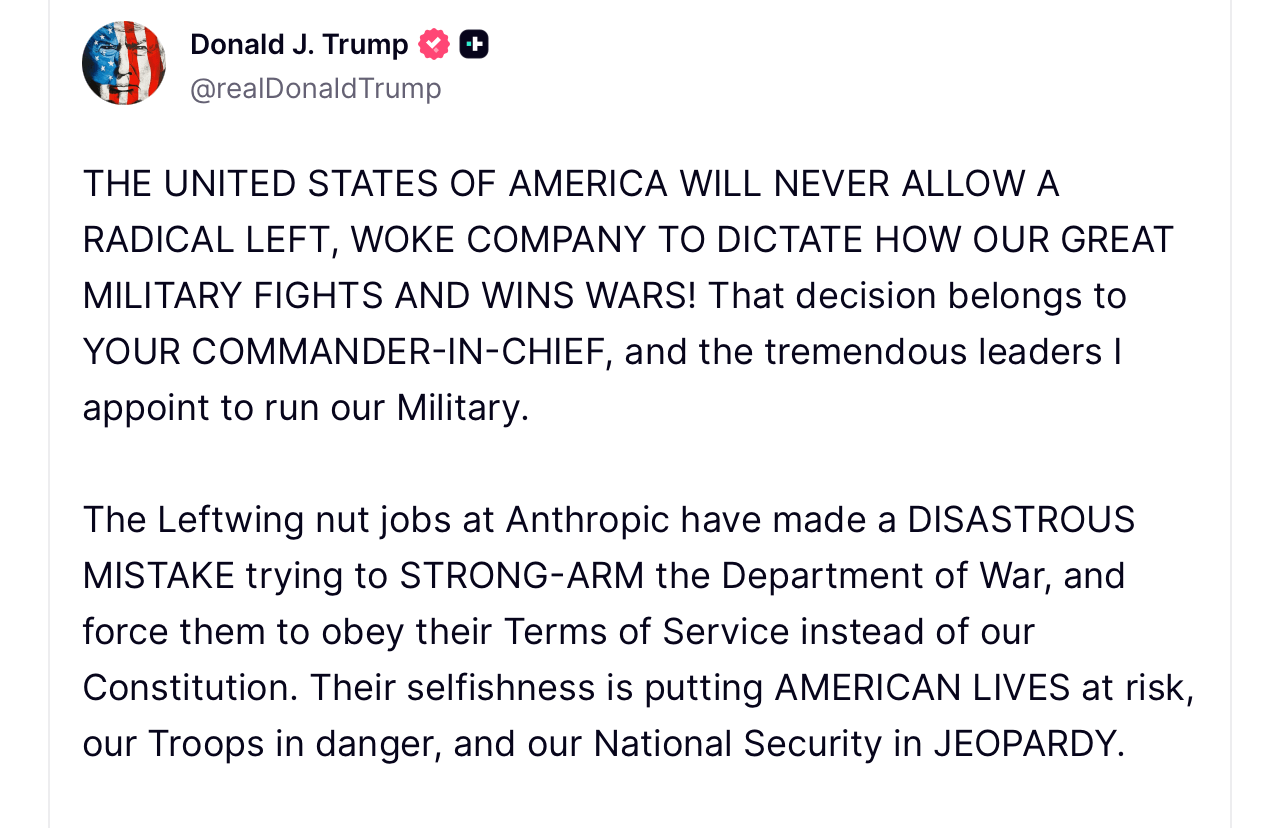

Die Verhandlungen scheiterten nach einem Treffen zwischen Anthropic-CEO Dario Amodei und Verteidigungsminister Pete Hegseth am 24. Februar. Einige Tage später, am 27. Februar, veröffentlichte Präsident Donald Trump einen Beitrag auf Truth Social, in dem er die Bundesbehörden anwies, die Nutzung der Anthropic-Technologie „sofort einzustellen”, und die fortgesetzte Abhängigkeit von dem Unternehmen als „katastrophalen Fehler” bezeichnete.

Kurz darauf stufte Hegseth Anthropic gemäß der in 10 U.S.C. § 3252 festgelegten Bundesbeschaffungsbehörde als Risiko für die Lieferkette ein. Diese Einstufung, die in einem Schreiben an das Unternehmen vom 4. März bestätigt wurde, verbietet bestimmten Auftragnehmern der Regierung die Nutzung von Technologien, die als anfällig für Sabotage oder ausländische Einflussnahme gelten.

Anthropic argumentiert, dass diese Maßnahme weit über den beabsichtigten Zweck hinausgeht. In Gerichtsunterlagen macht das Unternehmen geltend, dass die Einstufung für ausländische Sicherheitsbedrohungen und nicht für politische Meinungsverschiedenheiten mit inländischen Lieferanten gedacht war. In den Klagen wird behauptet, dass die Regierung es versäumt habe, die gesetzlich vorgeschriebenen „am wenigsten einschränkenden Mittel” anzuwenden, und stattdessen eine vom Unternehmen als inoffizielle schwarze Liste bezeichnete Maßnahme verhängt habe.

Die Gerichtsunterlagen werfen auch verfassungsrechtliche Bedenken auf. Anthropic argumentiert, dass die Einstufung gegen den Ersten Verfassungszusatz verstößt, da das Unternehmen dafür bestraft wird, dass es sich öffentlich für Beschränkungen der KI-Nutzung wie autonome Waffen und Überwachung im Inland einsetzt. Der Klage zufolge schadet die Einstufung des Unternehmens als Risiko für die nationale Sicherheit seinem Ruf und könnte Verträge in Höhe von mehreren hundert Millionen Dollar gefährden.

Anthropic fordert die Gerichte auf, die Durchsetzung der Einstufung zu blockieren, den Bundesbehörden zu untersagen, die Richtlinien zur Einstellung der Geschäftsbeziehungen mit dem Unternehmen aufrechtzuerhalten, und ähnliche Maßnahmen in Zukunft zu verhindern. Das Unternehmen erklärte, sein Ziel sei es nicht, die Regierung zum Kauf seiner Technologie zu zwingen, sondern Vergeltungsmaßnahmen aufgrund politischer Differenzen zu verhindern. „Die Beantragung einer gerichtlichen Überprüfung ändert nichts an unserem langjährigen Engagement, KI zum Schutz unserer nationalen Sicherheit einzusetzen“, erklärte ein Sprecher von Anthropic in einer Stellungnahme. „Dies ist jedoch ein notwendiger Schritt, um unser Geschäft, unsere Kunden und unsere Partner zu schützen.“ Vertreter des Pentagon haben sich unter Verweis auf die Politik bezüglich laufender Gerichtsverfahren nicht öffentlich zu dem Rechtsstreit geäußert. Einige Verteidigungsführer haben zuvor argumentiert, dass Militärbehörden in Notfällen die volle operative Kontrolle über die Technologien von Auftragnehmern behalten müssen und es nicht zulassen dürfen, dass Anbieter vorschreiben, wie Systeme zu verwenden sind.

Das wilde Wochenende der KI: Umwälzungen bei OpenAI, Konflikt mit dem Pentagon und Roboter, die sich weigern zu sterben

AI-Umwälzungen kommen schnell: OpenAI-Drama, Konflikt zwischen Pentagon und Anthropic, Einführung von GPT-5.4, selbstheilende Roboter und neue Sicherheitstools. read more.

Jetzt lesen

Das wilde Wochenende der KI: Umwälzungen bei OpenAI, Konflikt mit dem Pentagon und Roboter, die sich weigern zu sterben

AI-Umwälzungen kommen schnell: OpenAI-Drama, Konflikt zwischen Pentagon und Anthropic, Einführung von GPT-5.4, selbstheilende Roboter und neue Sicherheitstools. read more.

Jetzt lesen

Das wilde Wochenende der KI: Umwälzungen bei OpenAI, Konflikt mit dem Pentagon und Roboter, die sich weigern zu sterben

Jetzt lesenAI-Umwälzungen kommen schnell: OpenAI-Drama, Konflikt zwischen Pentagon und Anthropic, Einführung von GPT-5.4, selbstheilende Roboter und neue Sicherheitstools. read more.

Der Streit kommt zu einer Zeit, in der der Wettbewerb um militärische KI-Aufträge immer intensiver wird. Konkurrierende Unternehmen, darunter OpenAI, haben etwa zur gleichen Zeit, als die Verhandlungen mit Anthropic scheiterten, Vereinbarungen mit dem Pentagon getroffen. Unterdessen haben wichtige Technologiepartner wie Google und Microsoft angekündigt, dass sie beabsichtigen, die Zusammenarbeit mit Anthropic bei kommerziellen Dienstleistungen, die nicht mit der Verteidigung in Zusammenhang stehen, fortzusetzen.

Branchenanalysten sagen, dass das Ergebnis des Verfahrens einen Präzedenzfall dafür schaffen könnte, wie die Bundesregierung KI-Unternehmen dazu drängt, ihre Sicherheitsrichtlinien zu ändern, wenn nationale Sicherheitsinteressen auf dem Spiel stehen. Vorerst bleiben die Verbraucherprodukte und kommerziellen KI-Dienstleistungen von Anthropic verfügbar, während der Rechtsstreit um die Einstufung durch das Pentagon seinen Weg durch die Gerichte nimmt.

FAQ 🧭

- Warum hat Anthropic die US-Regierung verklagt? Anthropic reichte Klage ein und behauptete, das Pentagon habe das Unternehmen unrechtmäßig als Risiko für die nationale Sicherheit eingestuft, nachdem es sich geweigert hatte, KI-Sicherheitsbeschränkungen aufzuheben.

- Was hat den Streit zwischen Anthropic und dem Pentagon ausgelöst? Der Konflikt begann während der Vertragsverhandlungen, als das Verteidigungsministerium die uneingeschränkte Nutzung des KI-Systems Claude von Anthropic forderte.

- Was bedeutet die Einstufung als „Risiko für die Lieferkette“? Diese Einstufung kann dazu führen, dass Auftragnehmer der Regierung die Technologie eines Unternehmens nicht mehr nutzen dürfen, wenn Beamte der Ansicht sind, dass sie Sicherheits- oder Beschaffungsrisiken birgt.

- Werden die KI-Dienste von Anthropic während des Rechtsstreits weiterhin funktionieren? Ja, die kommerziellen KI-Produkte und Verbraucherdienste von Anthropic bleiben während des Rechtsstreits verfügbar.