Verteidigungsminister Pete Hegseth traf sich am Dienstag im Pentagon mit Dario Amodei, dem CEO von Anthropic, nachdem das Verteidigungsministerium Anthropic dazu gedrängt hatte, die Beschränkungen für sein künstliches Intelligenzsystem (KI) Claude aufzuheben, andernfalls drohten mögliche Strafen.

Bericht: Anthropic's Claude AI steht vor ungewisser Zukunft in geheimen Pentagon-Systemen

Militärische KI-Governance in hochbrisantem Pentagon-Treffen auf dem Prüfstand

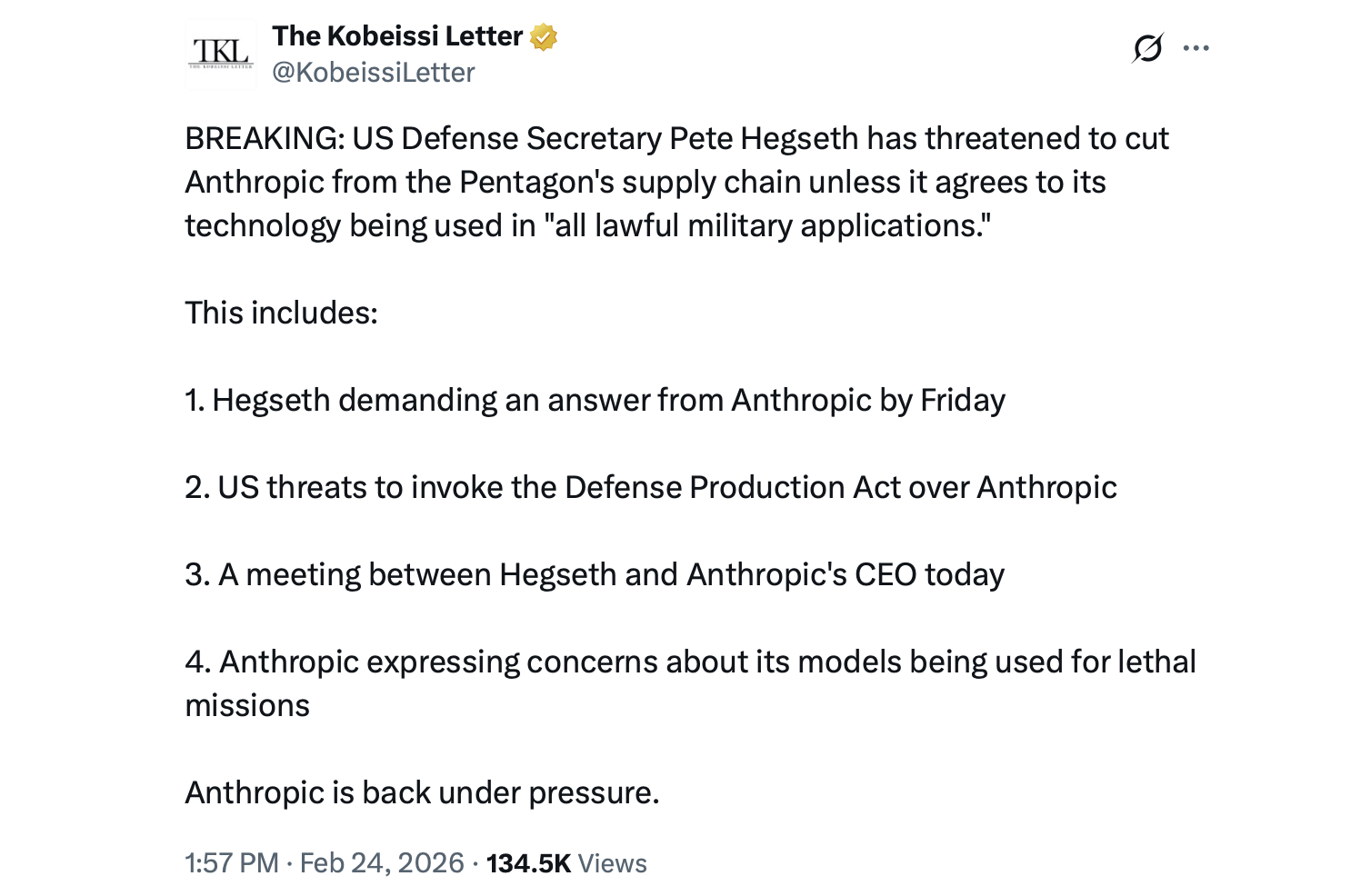

Das Treffen am 24. Februar folgte auf wochenlange Spannungen wegen der Nutzungsrichtlinien von Anthropic für Claude, das große Sprachmodell, das im Rahmen eines Pilotvertrags mit einem Wert von bis zu 200 Millionen US-Dollar bis 2025 in die geheimen Netzwerke des Verteidigungsministeriums integriert wurde. Claude ist derzeit das einzige vollständig autorisierte große Sprachmodell, das in bestimmten sicheren Systemen des Pentagon eingesetzt wird.

Laut einem Bericht von Axios lehnte Hegseth, zusammen mit dem stellvertretenden Minister Steve Feinberg und dem General Counsel Earl Matthews, die Beschränkungen von Anthropic hinsichtlich der Massenüberwachung von Amerikanern und vollständig autonomen Waffensystemen, die ohne menschliche Aufsicht betrieben werden, ab. Verteidigungsbeamte argumentierten, dass diese Beschränkungen rechtmäßige militärische Anwendungen einschränken und nicht über die Befugnisse des Kongresses und der Exekutive hinausgehen sollten.

Anthropic hat stets betont, dass seine Sicherheitsvorkehrungen darauf ausgelegt sind, Missbrauch zu verhindern und gleichzeitig Anwendungen im Bereich der nationalen Sicherheit zu ermöglichen. Das Unternehmen gibt an, dass seine Richtlinien legitime militärische Anwendungen nicht blockieren, sondern lediglich Aktivitäten wie die Verfolgung von Personen ohne deren Zustimmung oder den Einsatz tödlicher Systeme ohne menschliche Kontrolle verbieten.

„Laut einer mit den Gesprächen vertrauten Quelle hat Anthropic nie Einwände gegen die Verwendung seiner Modelle für ‚legitime Militäroperationen‘ erhoben“, berichtete Jennifer Griffin, Chefkorrespondentin für nationale Sicherheit bei Fox News, auf X. „Es teilte Hegseth außerdem mit, dass es sich nie beim Pentagon oder Palantir über die Verwendung seiner Modelle bei der Maduro-Razzia beschwert habe.“

Claude wurde für die Analyse von Geheimdienstinformationen, die Cyberabwehr und die Einsatzplanung eingesetzt. Berichten zufolge unterstützte es die Planung und Echtzeitanalyse während der Operation am 3. Januar, die zur Festnahme des venezolanischen Präsidenten Nicolás Maduro führte. Anthropic bat später im Rahmen einer internen Compliance-Prüfung um Klarstellung hinsichtlich der Beteiligung des Modells, was von Pentagon-Beamten als Kritik interpretiert wurde.

Am 9. Januar veröffentlichte Hegseth ein Memo, in dem er Anbieter von künstlicher Intelligenz (KI) aufforderte, die von ihm als restriktiv bezeichneten Bedingungen zu entfernen. Diese Anweisung bereitete den Weg für Neuverhandlungen und schließlich für das Treffen am 24. Februar.

Das Pentagon hat Anthropic eine Frist bis zum 27. Februar gesetzt, um seine Bedingungen zu ändern. Mögliche Reaktionen sind die Anwendung des Defense Production Act, um die Einhaltung der Vorschriften zu erzwingen, oder die Einstufung von Anthropic als Risiko für die Lieferkette, was dazu führen könnte, dass Auftragnehmer sich von Claude-bezogenen Systemen trennen müssen.

Beamte räumen ein, dass die Trennung von Claude von der bestehenden Infrastruktur operativ komplex wäre. Dennoch hat das Ministerium Alternativen. Konkurrenten wie xAI mit seinem Grok-Modell, OpenAI mit ChatGPT und Google mit Gemini stehen unter ähnlichen Verträgen mit dem Verteidigungsministerium und könnten in der Lage sein, ihre Rolle auszuweiten, wenn die Gespräche scheitern. Der Streit wirft weitergehende Fragen zur KI-Governance im militärischen Bereich auf, insbesondere da sich das Bundesrecht im Hinblick auf neue Technologien weiterentwickelt. Es geht darum, ob private KI-Entwickler unabhängige ethische Richtlinien beibehalten können, wenn ihre Systeme in nationale Sicherheitsoperationen eingebunden werden.

Die Reaktionen in den sozialen Medien waren bemerkenswert offen. „Die Überwachung ohne richterliche Anordnung ist zurück“, schrieb ein X-Nutzer als Antwort auf Griffins X-Beitrag. „Das muss eine viel größere Nachricht sein, als es derzeit ist. Es besteht eine ernsthafte Gefahr von Verfassungsverstößen“, antwortete ein anderer auf Griffins Beitrag. Andere scherzten mit einer Prise schwarzem Humor, dass die Ankunft von Skynet vielleicht nicht mehr weit sei. „Skynet ist da … die Zeitlinie von 2029 ist LIVE“, bemerkte die Person. Beide Seiten haben die Diskussion vom 24. Februar als substanziell bezeichnet. Ob Anthropic seine Sicherheitsvorkehrungen vor Ablauf der Frist anpasst, könnte über die Zukunft einer der fortschrittlichsten KI-Integrationen des Pentagon entscheiden.

FAQ 🤖

- Was wurde bei dem Treffen im Pentagon am 24. Februar besprochen? Im Mittelpunkt des Treffens standen die Einschränkungen von Anthropic für Claude AI und die Frage, ob diese rechtmäßige militärische Anwendungen einschränken.

- Warum übt das Pentagon Druck auf Anthropic aus? Vertreter des Verteidigungsministeriums argumentieren, dass die Sicherheitsvorkehrungen des Unternehmens autorisierte Anwendungen im Bereich der nationalen Sicherheit beeinträchtigen.

- Was könnte passieren, wenn Anthropic nicht nachgibt? Das Pentagon könnte sich auf das Verteidigungsproduktionsgesetz berufen oder das Unternehmen als Risiko für die Lieferkette einstufen.

- Gibt es Alternativen zu Claude? Ja, Modelle von xAI, OpenAI und Google stehen unter Verträgen mit dem Verteidigungsministerium und könnten bei Bedarf erweitert werden.