Forsvarsminister Pete Hegseth mødtes tirsdag med Anthropics CEO Dario Amodei i Pentagon, mens Forsvarsministeriet pressede Anthropic til at fjerne begrænsninger på sit Claude-system for kunstig intelligens (AI) — ellers kunne der komme mulige sanktioner.

Rapport: Anthropics Claude AI står over for en usikker fremtid i klassificerede Pentagon-systemer

Militær AI-styring sættes på prøve i et højrisikomøde i Pentagon

Mødet den 24. februar fulgte efter ugers spændinger om Anthropics brugsregler for Claude, den store sprogmodel, der er integreret i klassificerede netværk i Forsvarsministeriet under en pilotkontrakt fra 2025 med en værdi på op til 200 mio. dollars. Claude er i øjeblikket den eneste fuldt autoriserede store sprogmodel, der opererer på tværs af visse sikre Pentagon-systemer.

Ifølge Axios’ rapportering protesterede Hegseth, ledsaget af viceminister Steve Feinberg og chefjurist Earl Matthews, mod Anthropics begrænsninger for masseovervågning af amerikanere og for fuldt autonome våbensystemer, der opererer uden menneskelig overvågning. Forsvarsembedsmænd hævdede, at disse grænser indskrænker lovlige militære anvendelser og ikke bør tilsidesætte kongressens og den udøvende magts myndighed.

Anthropic har fastholdt, at dets sikkerhedsforanstaltninger er udformet til at forhindre misbrug, samtidig med at de fortsat muliggør anvendelser inden for national sikkerhed. Virksomheden siger, at dens politikker ikke blokerer legitim militær brug, men forbyder aktiviteter såsom at spore personer uden samtykke eller at implementere dødelige systemer uden menneskelig kontrol.

“Ifølge en kilde med kendskab til samtalerne har Anthropic aldrig gjort indsigelse mod brugen af dets modeller til ‘legitime militære operationer’,” rapporterede Fox News’ chefkorrespondent for national sikkerhed, Jennifer Griffin, på X. “Det sagde også til Hegseth, at det aldrig klagede til Pentagon eller Palantir over brugen af dets modeller i Maduro-razziaen.”

Claude er blevet brugt til efterretningsanalyse, cyberforsvar og operationel planlægning. Rapporter indikerer, at den understøttede planlægning og realtidsanalyse under operationen den 3. januar, der resulterede i tilfangetagelsen af Venezuelas præsident Nicolás Maduro. Anthropic søgte senere afklaring om modellens involvering som led i en intern compliance-gennemgang, hvilket Pentagon-embedsmænd fortolkede som kritik.

Den 9. januar udstedte Hegseth et notat, der opfordrede udbydere af kunstig intelligens (AI) til at fjerne det, han beskrev som restriktive betingelser. Denne instruktion satte scenen for genforhandlinger og i sidste ende mødet den 24. februar.

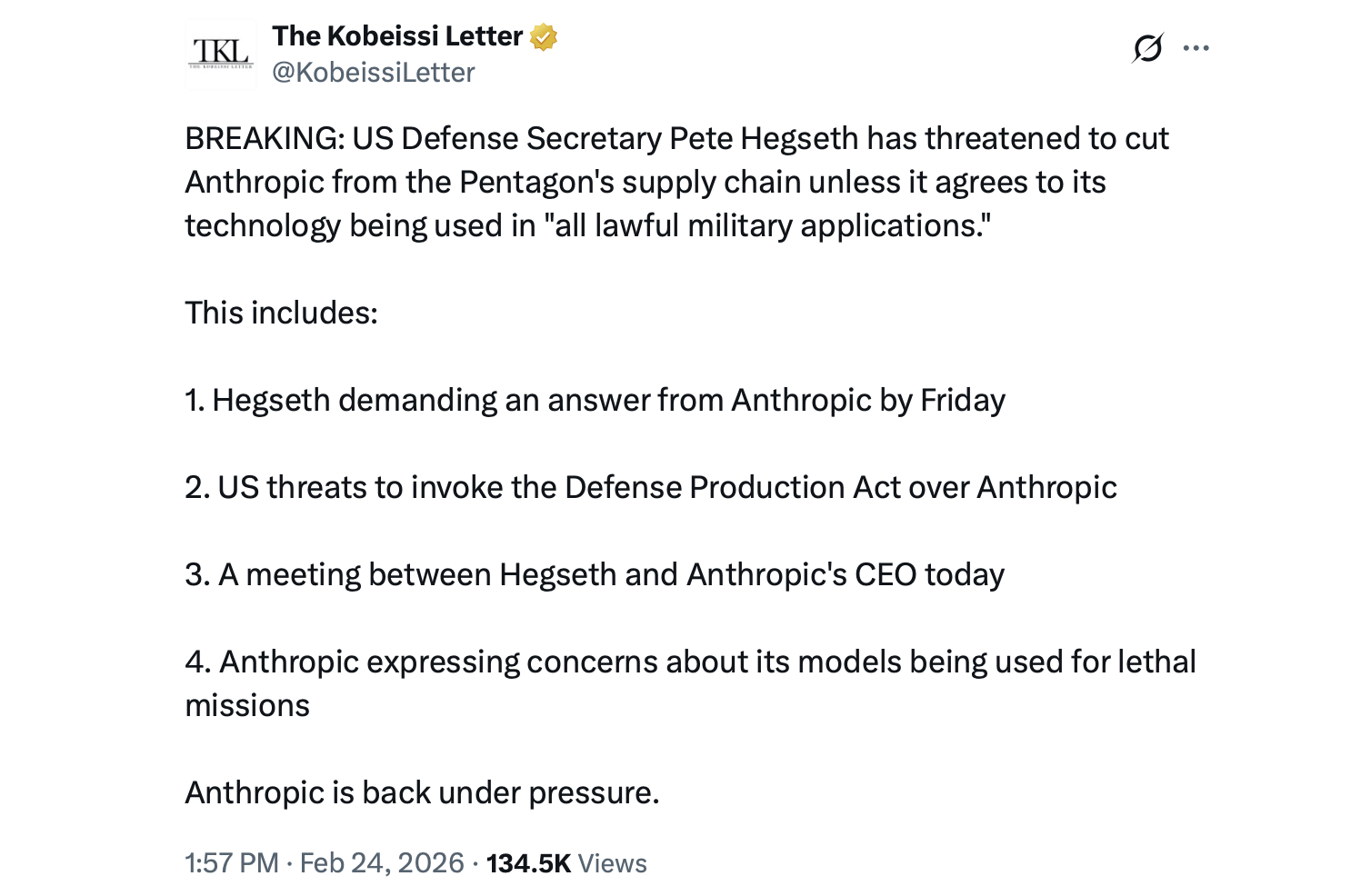

Pentagon har fastsat en frist den 27. februar for, at Anthropic skal ændre sine vilkår. Mulige reaktioner omfatter at påberåbe sig Defense Production Act for at tvinge til efterlevelse eller at udpege Anthropic som en risiko i forsyningskæden — et skridt, der kan kræve, at kontrahenter frasælger Claude-relaterede systemer.

Embedsmænd anerkender, at det operationelt ville være komplekst at afkoble Claude fra den eksisterende infrastruktur. Alligevel har ministeriet alternativer. Konkurrenter som xAI med sin Grok-model, OpenAI med ChatGPT og Google med Gemini er under tilsvarende kontrakter med Forsvarsministeriet og kan være positioneret til at udvide deres roller, hvis forhandlingerne bryder sammen.

Striden fremhæver bredere spørgsmål om AI-styring i militære sammenhænge, især i takt med at føderal lovgivning fortsat udvikler sig omkring nye teknologier. På spil er, om private AI-udviklere kan fastholde uafhængige etiske politikker, når deres systemer bliver indlejret i nationale sikkerhedsoperationer.

Reaktionerne på tværs af sociale medieplatforme har været bemærkelsesværdigt ligefremme. “Overvågning med færre kendelser er tilbage,” skrev en X-bruger som reaktion på Griffins X-opslag. “Det her burde være meget større nyhed, end det er. Der er en alvorlig risiko for forfatningskrænkelser,” svarede en anden på Griffins tekst. Andre, med en dosis sort humor, jokede med, at Skynets ankomst måske ikke er langt væk. “Skynet er her… 2029-tidslinjen er LIVE,” bemærkede personen.

Begge sider har karakteriseret drøftelsen den 24. februar som substantiel. Om Anthropic justerer sine sikkerhedsforanstaltninger inden fristen, kan afgøre fremtiden for en af Pentagons mest avancerede AI-integrationer.

FAQ 🤖

- Hvad blev der drøftet på Pentagon-mødet den 24. februar?

Mødet fokuserede på Anthropics begrænsninger for Claude AI, og om de begrænser lovlige militære anvendelser. - Hvorfor lægger Pentagon pres på Anthropic?

Forsvarsembedsmænd hævder, at virksomhedens sikkerhedsforanstaltninger griber forstyrrende ind i autoriserede anvendelser inden for national sikkerhed. - Hvad kan der ske, hvis Anthropic ikke efterkommer kravet?

Pentagon kan påberåbe sig Defense Production Act eller udpege virksomheden som en risiko i forsyningskæden. - Findes der alternativer til Claude?

Ja, modeller fra xAI, OpenAI og Google er under kontrakter med Forsvarsministeriet og kan udvides efter behov.

Tags i denne artikel

Bitcoin Gaming Picks

425% op til 5 BTC + 100 Gratis Spins