Anthropic har taget det ekstraordinære skridt at sagsøge den amerikanske regering, efter at Pentagon stemplede kunstig intelligens (AI)-virksomheden som en “forsyningskæderisiko for den nationale sikkerhed”, hvilket har udløst et juridisk opgør, der kan omforme, hvordan Washington kontrollerer leverandører af kunstig intelligens, der arbejder med militæret.

Dario Amodeis Anthropic sagsøger den amerikanske regering og siger, at Pentagon gengældte på grund af AI-sikkerhedsforanstaltninger

Anthropic tager kampen op mod Forsvarsministeriet i et banebrydende AI-søgsmål

Ifølge flere rapporter indgav Anthropic den 9. marts to søgsmål ved en føderal domstol, der anfægter handlinger foretaget af det amerikanske forsvarsministerium og Trump-administrationen, idet virksomheden hævder, at regeringen ulovligt gengældte mod selskabet, efter at det nægtede at fjerne sikkerhedsforanstaltninger fra sit Claude-system til kunstig intelligens. Søgsmålene retter sig mod en betegnelse, der typisk anvendes på udenlandske modstandere, der mistænkes for spionage eller sabotage, ikke indenlandske teknologivirksomheder.

Striden kan spores tilbage til kontraktforhandlinger mellem Anthropic og Pentagon om, hvordan virksomhedens Claude AI-model kunne bruges af amerikanske forsvarsmyndigheder. Anthropic havde tidligere støttet nationale sikkerhedsinitiativer og blev i juni 2024 den første frontier-AI-virksomhed til at implementere modeller på klassificerede amerikanske regeringsnetværk, hvor de assisterede analytikere og militære planlæggere med efterretningsevaluering, simulationer, operativ planlægning og cybersikkerhedsarbejde.

Spændingerne eskalerede, da Forsvarsministeriet krævede ubegrænset adgang til Claude til “alle lovlige formål” som led i en kontraktfornyelse. Anthropic indvilgede i de fleste betingelser, men insisterede på to begrænsninger: at forbyde brugen af dets AI til omfattende indenlandsk masseovervågning af amerikanere og at forhindre implementering i fuldt autonome dødelige våbensystemer.

Virksomhedens ledelse argumenterede for, at disse værn var nødvendige, fordi nuværende frontier-AI-modeller stadig er for upålidelige til autonome våben, og fordi storskala overvågningsprogrammer kan komme i konflikt med forfatningsmæssige beskyttelser. Anthropic udtalte, at begrænsningerne aldrig havde forstyrret nogen militær mission under selskabets tidligere arbejde med regeringen.

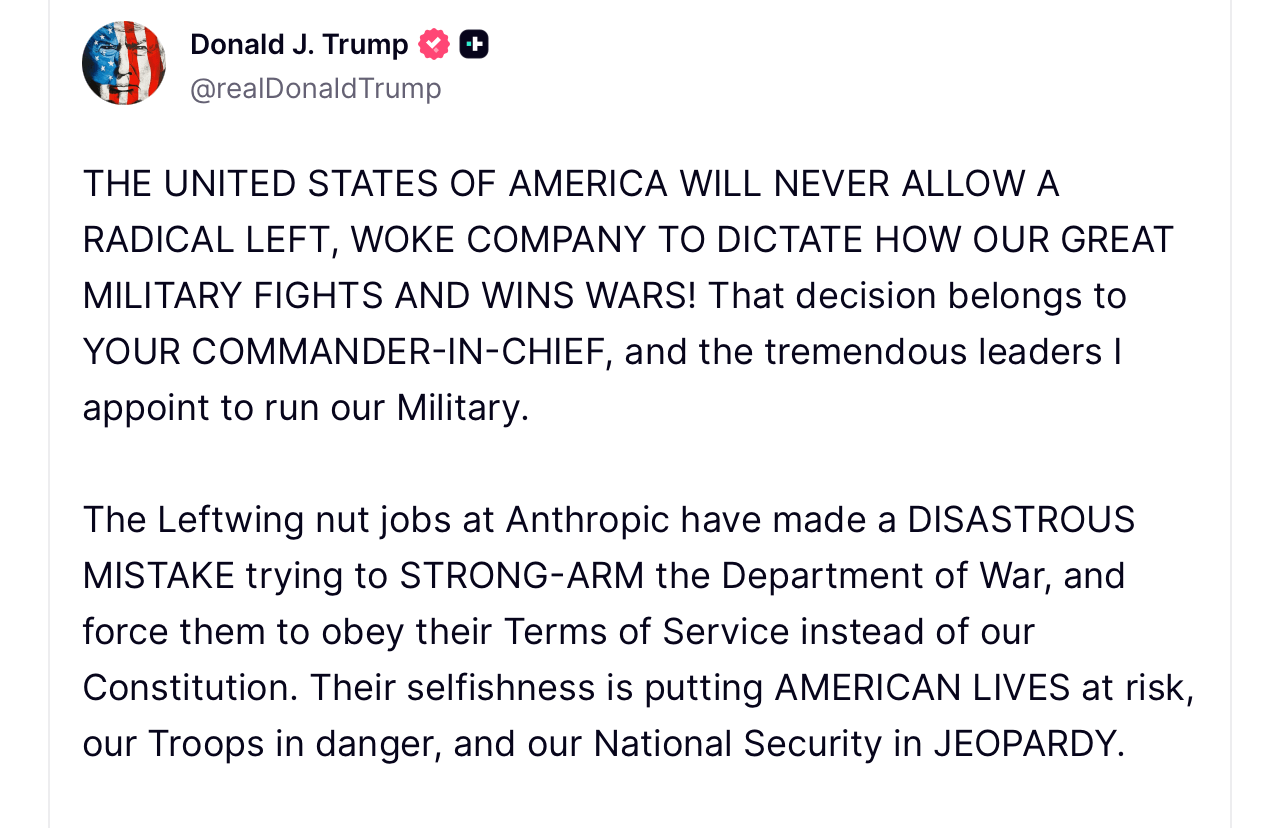

Forhandlingerne brød sammen efter et møde den 24. februar mellem Anthropic-CEO Dario Amodei og forsvarsminister Pete Hegseth. Få dage senere, den 27. februar, skrev præsident Donald Trump på Truth Social og instruerede føderale myndigheder i “øjeblikkeligt at ophøre” med at bruge Anthropic-teknologi, idet han beskrev fortsat afhængighed af virksomheden som en “katastrofal fejl”.

Kort tid efter tog Hegseth skridt til at klassificere Anthropic som en forsyningskæderisiko under føderal indkøbsmyndighed beskrevet i 10 U.S.C. § 3252. Betegnelsen, bekræftet i et brev sendt til virksomheden omkring den 4. marts, begrænser visse regeringsleverandører i at bruge teknologi, der anses for sårbar over for sabotage eller udenlandsk indflydelse.

Anthropic hævder, at tiltaget strækker lovbestemmelsen langt ud over dens tilsigtede formål. I retsdokumenter anfører virksomheden, at betegnelsen var tiltænkt udenlandsforbundne sikkerhedstrusler snarere end politiske uenigheder med indenlandske leverandører. Søgsmålene hævder, at regeringen undlod at bruge de “mindst indgribende midler”, som loven kræver, og i stedet pålagde det, virksomheden beskriver som en uofficiel sortliste.

De juridiske indlæg rejser også forfatningsmæssige bekymringer. Anthropic argumenterer for, at betegnelsen krænker det første forfatningstillæg ved at straffe virksomheden for offentligt at have talt for begrænsninger i AI-anvendelser såsom autonome våben og indenlandsk overvågning. Ifølge stævningen skader det virksomhedens omdømme at blive stemplet som en national sikkerhedsrisiko og kan true kontrakter til en værdi af hundreder af millioner af dollars.

Anthropic beder domstolene om at blokere håndhævelsen af betegnelsen, pålægge føderale myndigheder at trække direktiver tilbage, der stopper forretninger med virksomheden, og forhindre lignende handlinger i fremtiden. Virksomheden sagde, at dens mål ikke er at tvinge regeringen til at købe dens teknologi, men at forhindre gengældelse på grund af politiske uenigheder.

“Det at søge domstolsprøvelse ændrer ikke vores langvarige forpligtelse til at udnytte AI til at beskytte vores nationale sikkerhed,” sagde en Anthropic-talsmand i en erklæring. “Men dette er et nødvendigt skridt for at beskytte vores forretning, vores kunder og vores partnere.”

Pentagon-embedsmænd har ikke offentligt kommenteret retssagen med henvisning til politik om igangværende retssager. Nogle forsvarsledere har tidligere argumenteret for, at militære myndigheder skal bevare fuld operationel kontrol over leverandørteknologier under nødsituationer og ikke kan lade leverandører diktere, hvordan systemer bruges.

AI’s Vilde Weekend: OpenAI-omvæltning, Pentagon-sammenstød og robotter, der nægter at dø

AI-omvæltninger rammer hurtigt: OpenAI-drama, Pentagon-sammenstød med Anthropic, lancering af GPT-5.4, selvreparerende robotter og nye sikkerhedsværktøjer. read more.

Læs nu

AI’s Vilde Weekend: OpenAI-omvæltning, Pentagon-sammenstød og robotter, der nægter at dø

AI-omvæltninger rammer hurtigt: OpenAI-drama, Pentagon-sammenstød med Anthropic, lancering af GPT-5.4, selvreparerende robotter og nye sikkerhedsværktøjer. read more.

Læs nu

AI’s Vilde Weekend: OpenAI-omvæltning, Pentagon-sammenstød og robotter, der nægter at dø

Læs nuAI-omvæltninger rammer hurtigt: OpenAI-drama, Pentagon-sammenstød med Anthropic, lancering af GPT-5.4, selvreparerende robotter og nye sikkerhedsværktøjer. read more.

Striden kommer, mens kapløbet om at sikre militære AI-kontrakter intensiveres. Rivaliserende virksomheder, herunder OpenAI, indgik aftaler med Pentagon omtrent på samme tid, som forhandlingerne med Anthropic brød sammen. Imens har store teknologipartnere som Google og Microsoft tilkendegivet, at de agter at fortsætte samarbejdet med Anthropic om kommercielle tjenester, der ikke er relateret til forsvar.

Brancheanalytikere siger, at udfaldet af sagen kan skabe en præcedens for, hvordan den føderale regering lægger pres på AI-virksomheder for at få dem til at ændre sikkerhedspolitikker, når nationale sikkerhedsinteresser er involveret. Indtil videre forbliver Anthropics forbrugerprodukter og kommercielle AI-tjenester tilgængelige, mens den juridiske kamp om Pentagon-betegnelsen begynder at gå sin gang gennem domstolene.

FAQ 🧭

- Hvorfor sagsøgte Anthropic den amerikanske regering?

Anthropic indgav søgsmål med påstand om, at Pentagon ulovligt stemplede virksomheden som en national sikkerhedsrelateret forsyningskæderisiko, efter at den nægtede at fjerne AI-sikkerhedsbegrænsninger. - Hvad udløste striden mellem Anthropic og Pentagon?

Konflikten begyndte under kontraktforhandlinger, da Forsvarsministeriet krævede ubegrænset brug af Anthropics Claude AI-system. - Hvad betyder betegnelsen “forsyningskæderisiko”?

Mærkningen kan begrænse regeringsleverandører i at bruge en virksomheds teknologi, hvis embedsmænd mener, at den udgør sikkerheds- eller indkøbsrisici. - Vil Anthropics AI-tjenester stadig fungere under retssagen?

Ja, Anthropics kommercielle AI-produkter og forbrugertjenester forbliver tilgængelige, mens retssagen behandles.