Et decentraliseret AI-eksperiment, der tidligere var forbeholdt kryptomiljøet, har netop fået offentlig anerkendelse fra Nvidias CEO, Jensen Huang, hvilket tyder på, at træning af distribuerede modeller måske er ved at vinde indpas i mainstream.

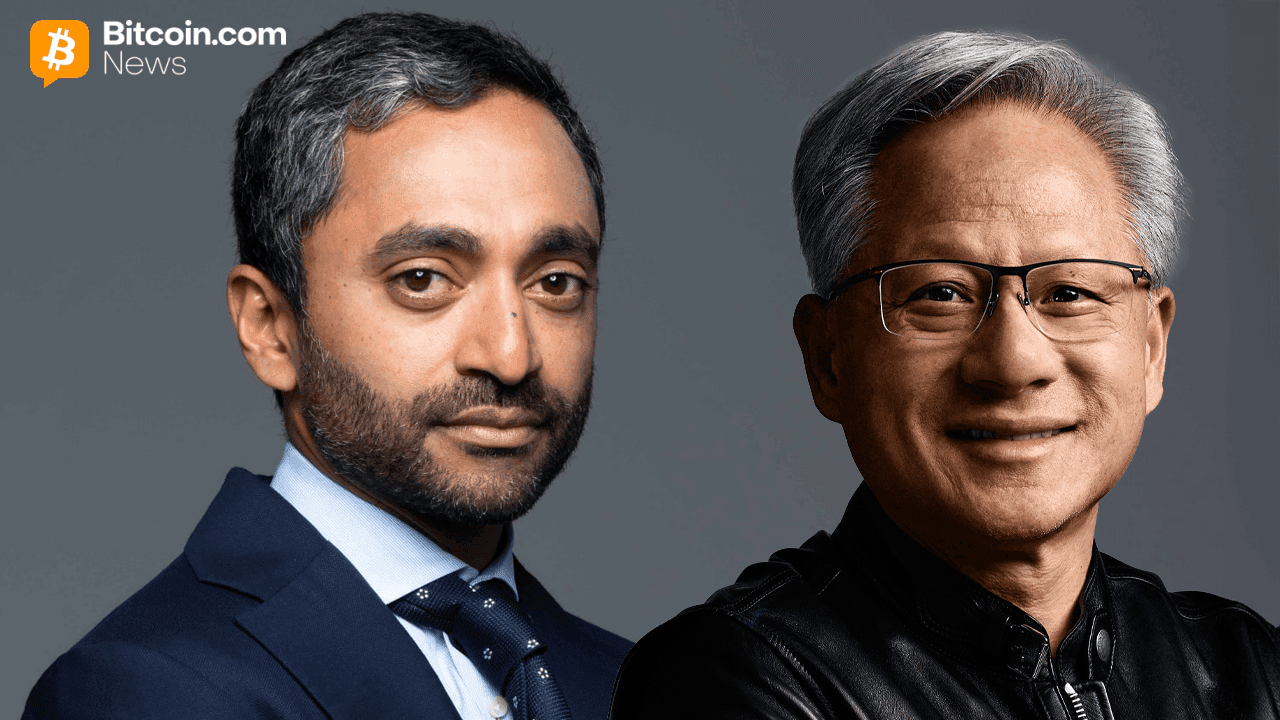

Bittensors milepæl inden for uddannelse tiltrækker opmærksomhed fra Chamath Palihapitiya og Nvidias CEO Jensen Huang

Open source-AI vinder frem med støtte fra Nvidias CEO

Chamath Palihapitiya satte fokus på Bittensors Covenant-72B under en episode af All-In Podcast og fremhævede det som et konkret eksempel på decentraliseret kunstig intelligens (AI), der går ud over teorien. Bittensor fungerer som et decentraliseret, blockchain-drevet netværk, der etablerer en peer-to-peer-markedsplads, hvor maskinlæringsmodeller og AI-beregninger udveksles og belønnes.

Palihapitiya beskrev indsatsen i klare vendinger: en storstilet sprogmodel (LLM), der er trænet uden centraliseret infrastruktur, men i stedet drevet af et netværk af uafhængige bidragydere. "De formåede at træne en LLaMA-model med 4 milliarder parametre, fuldstændig distribueret, med en række mennesker, der bidrog med overskydende regnekraft," sagde han og kaldte det "en ret vild teknisk bedrift."

Sammenligningen endte med en velkendt analogi. "Der er tilfældige mennesker, og hver person får en lille andel," tilføjede Palihapitiya med henvisning til det tidlige distribuerede computerprojekt, der udnyttede ledig hardware over hele verden.

Huang afviste ikke ideen. I stedet lænede han sig op ad en bredere ramme for AI-markedet og antydede, at decentraliserede og proprietære tilgange ikke udelukker hinanden. "Disse to ting er ikke A eller B; det er A og B," sagde Huang. "Der er ingen tvivl om det."

Den dobbelte vision afspejler en voksende kløft – og overlapning – inden for AI. På den ene side er der lukkede, højt polerede systemer som ChatGPT, Claude og Gemini. På den anden side er der åbne og decentraliserede modeller, der giver udviklere og organisationer mulighed for at tilpasse systemer til specifikke behov.

Huang gjorde det klart, at han ser begge spor som væsentlige. "Modeller er en teknologi, ikke et produkt," sagde han og bemærkede, at de fleste brugere fortsat vil stole på polerede, generelle systemer frem for at bygge deres egne fra bunden.

Samtidig pegede han på brancher, hvor tilpasning ikke er valgfri. "Der er alle disse brancher, hvor deres domæneekspertise… skal indfanges på en måde, som de kan kontrollere," forklarede Huang og tilføjede, at "det kan kun komme fra åbne modeller."

Denne udtalelse rammer lige ned i Bittensors kernekompetence. Covenant-72B, udviklet gennem Subnet 3 (Templar), repræsenterer en af de største decentraliserede træningskørsler til dato, hvor mere end 70 bidragydere koordineres via standard internetforbindelser uden en central myndighed.

Teknisk set flytter modellen grænser. Den er bygget med 72 milliarder parametre og trænet på cirka 1,1 billioner tokens og udnytter innovationer såsom komprimerede kommunikationsprotokoller og distribueret dataparallelisme for at gøre træning mulig uden for traditionelle datacentre.

Præstationsmålinger tyder på, at det ikke blot er eksperimentelt. Benchmark-resultater placerer det i konkurrence med etablerede centraliserede modeller, en detalje, der hjælper med at forklare, hvorfor projektet har vakt opmærksomhed ud over det krypto-native publikum.

Markedet har også bemærket det. Efter annonceringen er projektets token TAO steget 24 %, siden videoen med Palihapitiya og Huang gik viralt på sociale medier.

Nvidia støtter Nebius’ planer om en AI-fabrik med en massiv investering på 2 milliarder dollar

Se, hvordan Nvidia er med til at forme fremtidens databehandling med en investering på 2 milliarder dollar i AI-cloudinfrastruktur. read more.

Læs nu

Nvidia støtter Nebius’ planer om en AI-fabrik med en massiv investering på 2 milliarder dollar

Se, hvordan Nvidia er med til at forme fremtidens databehandling med en investering på 2 milliarder dollar i AI-cloudinfrastruktur. read more.

Læs nu

Nvidia støtter Nebius’ planer om en AI-fabrik med en massiv investering på 2 milliarder dollar

Læs nuSe, hvordan Nvidia er med til at forme fremtidens databehandling med en investering på 2 milliarder dollar i AI-cloudinfrastruktur. read more.

Alligevel tyder Huangs kommentarer på, at den virkelige historie ikke handler om disruption, men om sameksistens mellem de to. Proprietære AI-systemer vil sandsynligvis forblive dominerende for almindelige brugere, mens åbne og decentraliserede modeller vil finde deres plads i specialiserede, omkostningsfølsomme eller suverænitetsdrevne applikationer.

For startups skitserede Nvidia-CEO'en en pragmatisk strategi: start åbent, og indfør derefter proprietære fordele. "Alle startups, vi investerer i nu, er først open source og går derefter over til den proprietære model," sagde han.

Med andre ord tilhører fremtiden for AI måske ikke en enkelt arkitektur eller filosofi. Den tilhører måske dem, der kan navigere i begge – og ved, hvornår de skal bruge hver af dem.

FAQ 🔎

- Hvad er Bittensors Covenant-72B?

Et sprogmodel med 72 milliarder parametre, der er trænet gennem et decentraliseret netværk af bidragydere uden centraliseret infrastruktur. - Hvad sagde Jensen Huang om decentraliseret AI?

Han sagde, at åbne og proprietære AI-modeller vil eksistere side om side, og beskrev forholdet som "A og B" og ikke som et valg mellem dem. - Hvorfor er denne udvikling vigtig?

Den viser, at store AI-modeller kan trænes uden for traditionelle datacentre, hvilket udfordrer antagelser om infrastrukturbehov. - Hvordan påvirker dette AI-branchen?

Det understøtter en hybrid fremtid, hvor centraliserede platforme og decentraliserede modeller spiller forskellige roller på tværs af brancher.