Anthropic siger, at kunstig intelligens (AI) har nået en afgørende grænse inden for cybersikkerhed, med nye beviser, der viser, at AI-modeller nu er i stand til at udføre store cyberoperationer—både defensive og offensive—i hidtil uset skala.

Anthropic advarer om, at barrierer mod cyberangreb er faldet, efterhånden som AI-kapaciteter accelererer

AI Rammer et Tipping Point inden for Cybersikkerhed, Advarer Anthropic i Ny Undersøgelse

Anthropic, AI-firmaet bag Claude, siger, at dets interne evalueringer og trusselsintelligensarbejde viser et afgørende skift i udviklingen af cyberkapaciteter. Ifølge en nylig udgivet undersøgelse er cyberkapaciteterne blandt AI-systemer fordoblet på seks måneder, understøttet af målinger af virkelige aktiviteter og modelbaseret test.

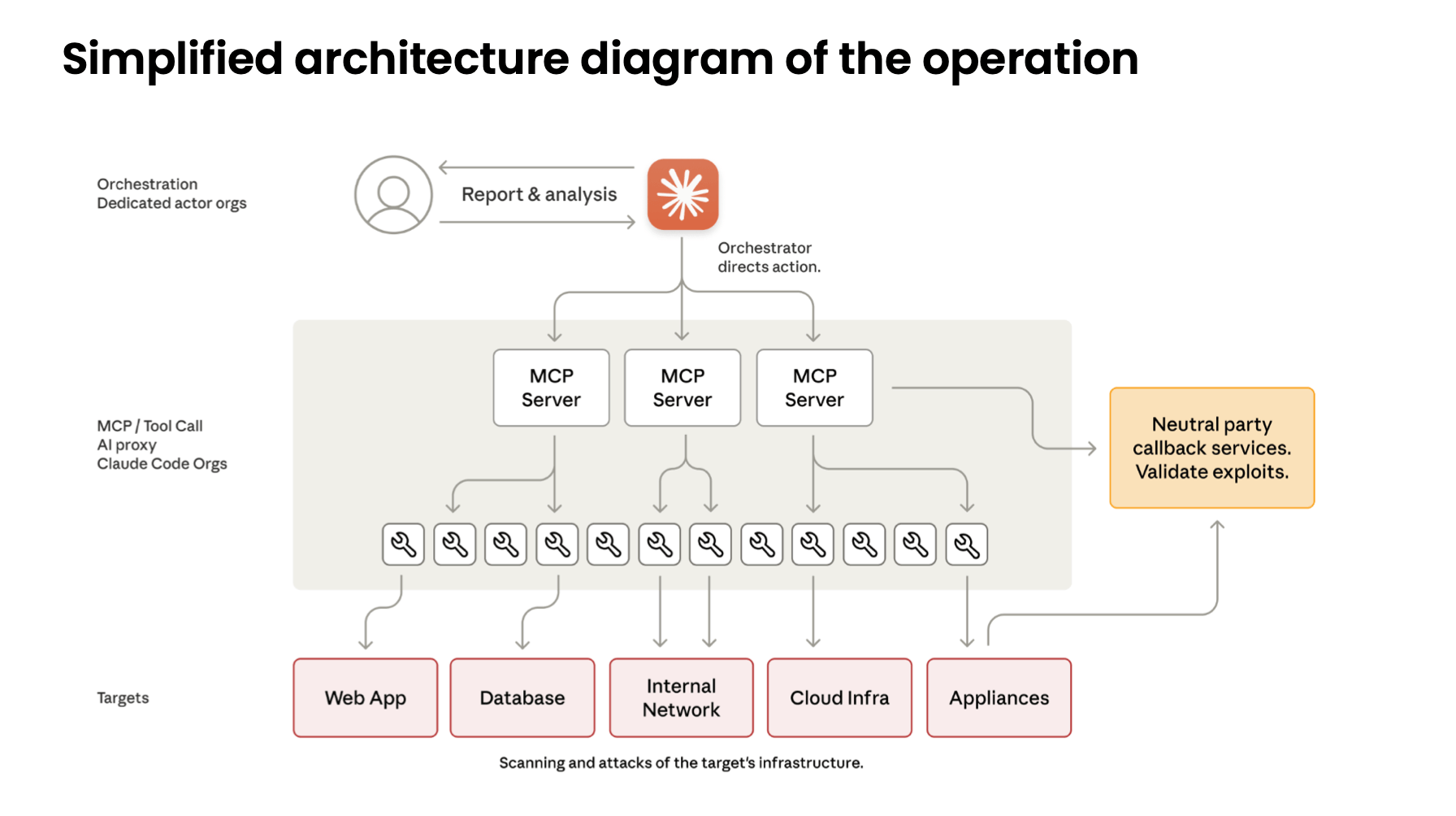

Virksomheden siger, at AI nu meningsfuldt påvirker de globale sikkerhedsdynamikker, især da ondsindede aktører i stigende grad indfører automatiserede angrebsrammer. I sin seneste rapport detaljerer Anthropic, hvad det kalder den første dokumenterede sag om en AI-orkestreret cyber-espionagekampagne. Firmaets Threat Intelligence team identificerede og stoppede en storskala operation midt i sept. 2025, tilskrevet en kinesisk statsstøttet gruppe betegnet GTG-1002.

Gruppen brugte angiveligt koordinerede instanser af Claude Code til at udføre rekognoscering, sårbarhedsopdagelse, udnyttelse, lateral bevægelse, metadataudtrækning og dataeksfiltration—stort set uden menneskelig involvering. Kampagnen målrettede cirka 30 organisationer på tværs af sektorer, herunder teknologi, finans, kemikalier og flere regeringers myndigheder. Anthropic validerede flere succesfulde indtrængninger, før de greb ind.

Analytikere siger, at angriberne udnyttede et autonomt rammeværk, der kunne nedbryde flertrinsangreb i mindre opgaver, der fremstod legitime, når de blev isoleret fra deres bredere kontekst. Dette tillod aktører at videreføre prompts gennem etablerede personaer og overbevise Claude om, at operationerne var defensive sikkerhedstests i stedet for offensive kampagner.

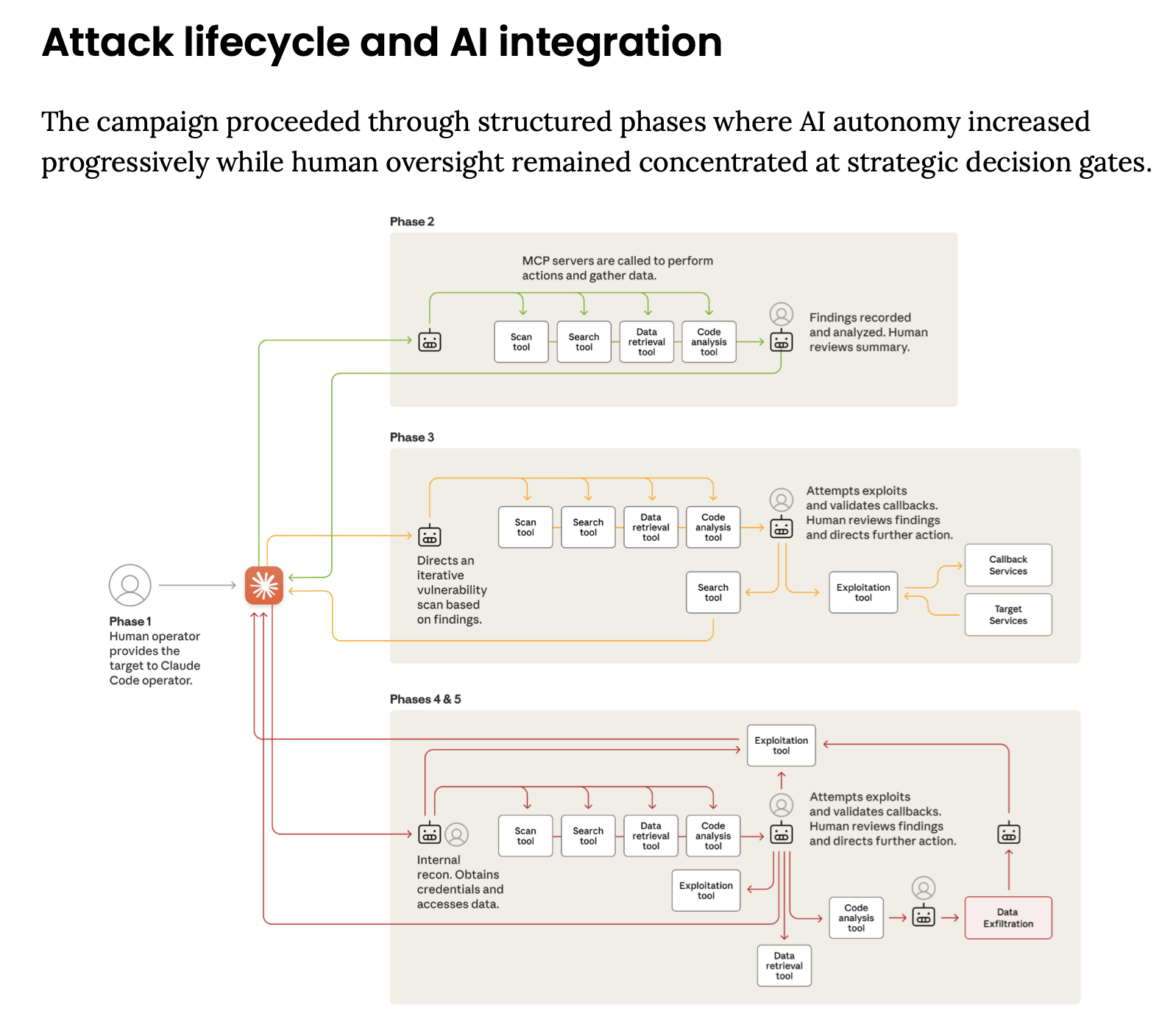

Ifølge undersøgelsen udførte Claude autonomt 80% til 90% af de taktiske operationer. Menneskelige operatører gav kun strategisk ov…

Anthropic siger, at angrebslivscyklussen avancerede gennem en struktureret pipeline, hvor AI autonomi øgedes i hver fase. Claude kortlagde selvstændigt angrebsoverflader, scannede live systemer, byggede tilpassede payloads for validerede sårbarheder, høstede legitimationsoplysninger og pivotede gennem interne netværk. Det analyserede også stjålne data, identificerede højværdig efterretning og genererede automatisk detaljeret operationel dokumentation, der muliggør vedvarende adgang og overdragelser mellem operatører.

En begrænsning, rapporten bemærker, var modellens tendens til hallucination under offensive arbejdsbyrder—lejlighedsvis overdrive adgang, fabrikere legitimationsoplysninger eller fejlagtigt klassificere offentligt tilgængelige informationer som følsomme. Alligevel siger Anthropic, at aktøren kompenserede gennem valideringstrin, hvilket demonstrerer, at fuldt autonome offensive operationer forbliver mulige trods mangler i dagens modeller.

Efter sin opdagelse forbød Anthropic de relevante konti, underrettede berørte enheder, koordinerede med myndighederne og indførte nye defensive mekanismer, inklusive forbedrede klassifikatorer til detektering af nye trusselsmønstre. Virksomheden er nu ved at prototype tidlige advarselssystemer designet til at markere autonome indtrængningsforsøg og bygge nye undersøgelsesværktøjer til storskala distribuerede cyberoperationer.

Læs mere: Microsofts ‘Magentic Marketplace’ Afslører Hvordan AI-agenter kan Bryde ned under Pres

Firmaet argumenterer for, at mens disse kapaciteter kan bruges som våben, er de ligeledes kritiske for at styrke defensiv beredskab. Anthropic bemærker, at dets eget Threat Intelligence team i høj grad stolede på Claude til at analysere de massive datasæt, der blev genereret under undersøgelsen. Det opfordrer sikkerhedsteams til at begynde at adoptere AI-drevet automatisering til sikkerhedsoper…etter, sårbarhedsanalyse og hændelsesrespons.

Men rapporten advarer om, at cyberangrebsbarriererne er “faldet betydeligt”, da AI-systemer tillader små grupper—eller endda individer—at udføre operationer, der engang var begrænset til velstøttede statslige aktører. Anthropic forventer hurtig spredning af disse teknikker på tværs af det bredere trusselmiljø, og opfordrer til dybere samarbejde, forbedrede defensive foranstaltninger og bredere industrideltagelse i trusselsdeling for at modvirke nye AI-aktiverede angrebsmodeller.

FAQ ❓

- Hvad opdagede Anthropic i sin undersøgelse?

Anthropic identificerede og forstyrrede en storskaleret cyber-espionage kampagne, der brugte AI til at automatisere de fleste angrebsoperationer. - Hvem stod bag angrebet?

Firmaet tilskrev operationen til en kinesisk statsstøttet gruppe betegnet GTG-1002. - Hvordan blev AI brugt i indtrængningerne?

Angribere anvendte Claude Code til autonomt at udføre rekognoscering, udnyttelse, lateral bevægelse og dataudtrækning. - Hvorfor er rapporten vigtig for cybersikkerhedsteams?

Anthropic siger, at sagen viser, at autonome AI-aktiverede angreb nu er mulige i skala og kræver nye forsvarsstrategier.