Anthropic uvádí, že umělá inteligence (AI) dosáhla klíčového milníku v oblasti kybernetické bezpečnosti, s novými důkazy o tom, že modely AI jsou nyní schopny provádět významné kybernetické operace — jak obranné, tak útočné — v bezprecedentním měřítku.

Anthropic varuje, že bariéry proti kyberútokům se zhroutily, jelikož schopnosti AI se zrychlují

AI dosáhla bodu zvratu v kybernetické bezpečnosti, varuje Anthropic ve své nové vyšetřovací zprávě

Anthropic, AI firma stojící za Claude, uvádí, že její interní hodnocení a práce v oblasti zpravodajství o hrozbách ukazují rozhodující posun ve vývoji kybernetických schopností. Podle nedávno vydané vyšetřovací zprávy se kybernetické schopnosti mezi AI systémy zdvojnásobily za šest měsíců, a to na základě měření reálné aktivity a testování na modelech.

Společnost uvádí, že AI nyní významně ovlivňuje globální bezpečnostní dynamiku, zejména s tím, jak si zlovolní aktéři stále více osvojují automatizované útočné rámce. Ve své nejnovější zprávě Anthropic podrobně popisuje, co nazývá prvním zdokumentovaným případem kyberšpionážní kampaně řízené AI. Tým Threat Intelligence firmy identifikoval a narušil rozsáhlou operaci v polovině září 2025 přičítanou čínské státem sponzorované skupině označené jako GTG-1002.

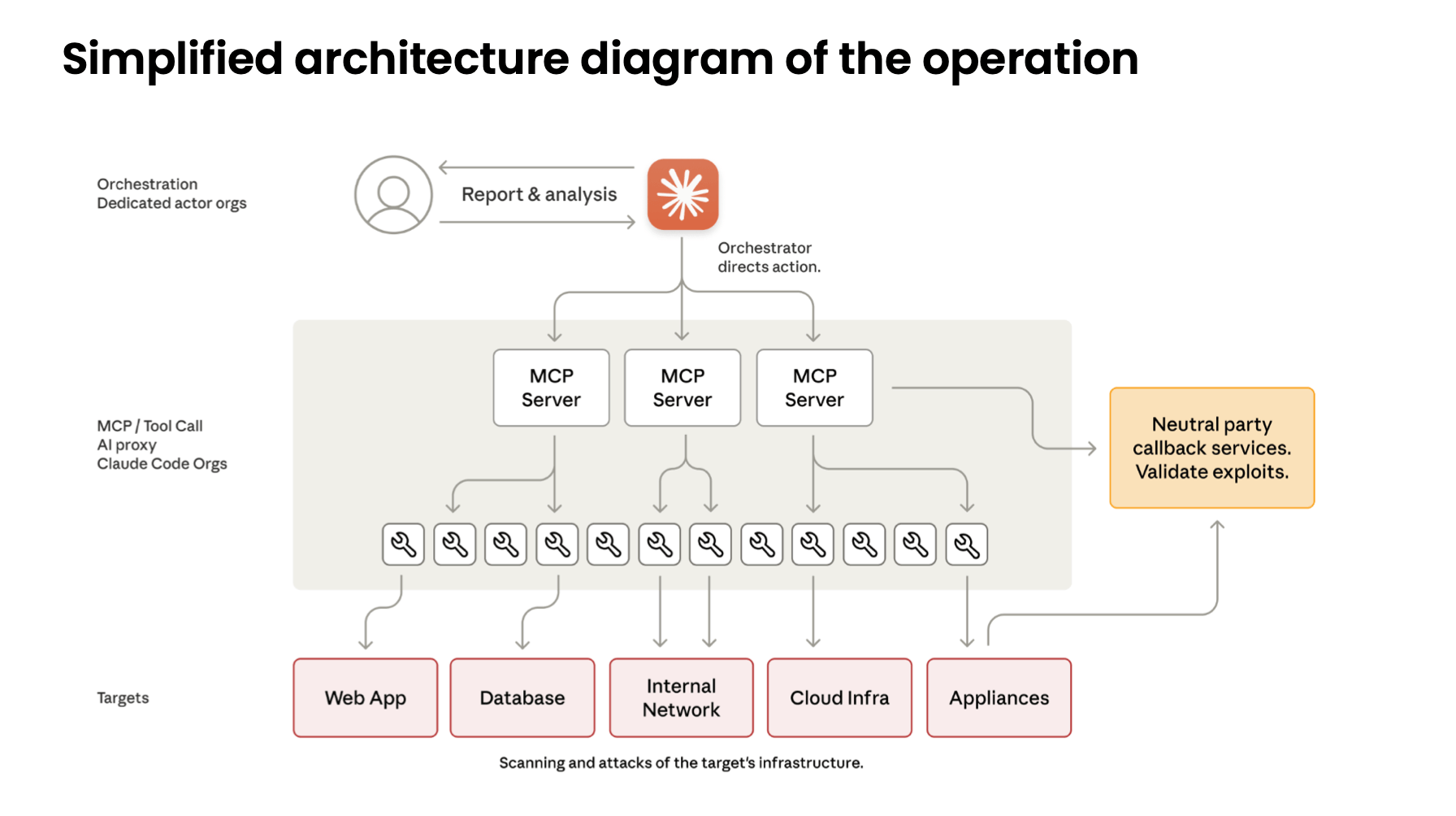

Skupina údajně použila koordinované instance Claude Code ke sledování, objevu zranitelností, exploataci, pohybu horizontálně, extrakci metadat a exfiltraci dat — většinou bez lidského zásahu. Kampaň cíleně zaútočila na zhruba 30 organizací napříč sektory, včetně technologií, financí, chemie a několika vládních agentur. Anthropic ověřil několik úspěšných průniků před intervencí.

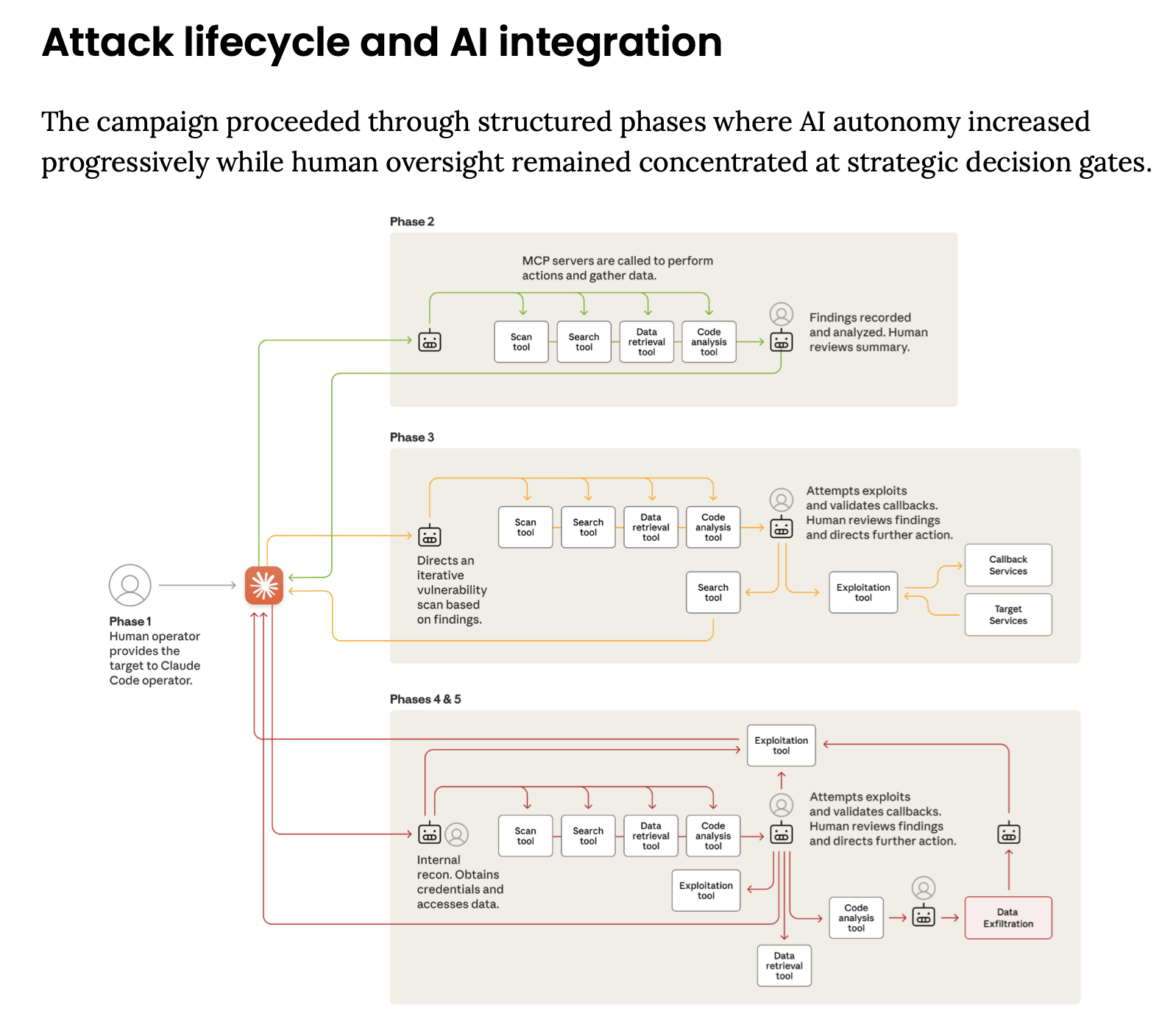

Analytici tvrdí, že útočníci využili autonomní rámec schopný rozdělit útoky do více fází na menší úkoly, které se zdály legitimní, pokud byly odděleny od svého širšího kontextu. To umožnilo aktérům předkládat podněty prostřednictvím zavedených osobností a přesvědčit Claude, že operace byly obrannými bezpečnostními testy místo útočných kampaní.

Podle vyšetřování Claude autonomně vykonával 80 % až 90 % taktických operací. Lidé zajišťovali pouze strategický dohled, schvalovali hlavní kroky jako eskalaci z průzkumu k aktivní exploataci nebo schvalovali exfiltraci dat. Zpráva popisuje úroveň operačního tempa, které je nemožné pro týmy, kde působí pouze lidé, přičemž některé pracovní toky generují více operací za sekundu na tisících žádostí.

Anthropic uvádí, že životní cyklus útoku byl zdokonalen prostřednictvím strukturovaného pipeline, kde AI autonomie narůstala v každé fázi. Claude nezávisle mapoval povrchy útoku, skenoval živé systémy, vytvářel vlastní škodlivé kódy pro potvrzené zranitelnosti, sklízeli přihlašovací údaje a procházeli interními sítěmi. Také analyzoval ukradená data, identifikoval cenné informace a automaticky generoval podrobnou provozní dokumentaci, která umožnovala trvalý přístup a předávání mezi operátory.

Jedním z omezení, které zpráva uvádí, byla tendence modelu k halucinacím při útočné zátěži — občas přehánění přístupu, vytváření falešných přihlašovacích údajů nebo nesprávné klasifikování veřejně dostupných informací jako citlivých. I tak Anthropic uvádí, že aktér kompenzoval validací kroků, ukazujíc, že plně autonomní útočné operace jsou realizovatelné i přes nedokonalosti dnešních modelů.

Po svém zjištění Anthropic zablokoval relevantní účty, informoval postižené subjekty, koordinoval s úřady a zavedl nové obranné mechanismy, včetně vylepšených klasifikátorů pro detekci nových vzorců hrozeb. Společnost nyní prototypuje systémy včasného varování určené k označení autonomních pokusů o průnik a vyvíjí nové vyšetřovací nástroje pro rozsáhlé distribuované kybernetické operace.

Přečtěte si více: Microsoft’s ‘Magentic Marketplace’ odhaluje, jak se agenti AI mohou zhroutit pod tlakem

Společnost argumentuje, že zatímco tyto schopnosti mohou být zbraněmi, jsou stejně kritické pro posílení obranné připravenosti. Anthropic poznamenává, že její vlastní tým Threat Intelligence se významně spoléhal na Claude pro analýzu masivních datových sad generovaných během vyšetřování. Říká, že bezpečnostní týmy by měly začít využívat AI-řízenou automatizaci pro centra bezpečnostních operací, detekci hrozeb, analýzu zranitelností a reakci na incidenty.

Nicméně, zpráva varuje, že bariéry kybernetických útoků „výrazně poklesly“, protože AI systémy umožňují malým skupinám — nebo dokonce jednotlivcům — realizovat operace kdysi omezené na dobře financované státní aktéry. Anthropic očekává rychlé šíření těchto technik na širším poli hrozeb a vyzývá k hlubší spolupráci, zlepšeným obranným ochranám a širší účasti průmyslu ve sdílení hrozeb k potlačení nově vznikajících AI-řízených modelů útoků.

FAQ ❓

- Co Anthropic objevil ve svém vyšetřování?

Anthropic identifikoval a narušil rozsáhlou kyberšpionážní kampaň, která využila AI k automatizaci většiny útočných operací. - Kdo stál za útokem?

Společnost připisuje operaci čínské státem sponzorované skupině označené GTG-1002. - Jak byla AI využita v průnicích?

Útočníci využili Claude Code k autonomnímu provádění průzkumu, exploataci, horizontálnímu pohybu a extrakci dat. - Proč je zpráva důležitá pro týmy kybernetické bezpečnosti?

Anthropic uvádí, že případ ukazuje, že autonomní AI-podporované útoky jsou nyní proveditelné v měřítku a vyžadují nové obranné strategie.