Anthropic učinil mimořádný krok a zažaloval vládu USA poté, co Pentagon označil firmu zabývající se umělou inteligencí (AI) za „riziko dodavatelského řetězce pro národní bezpečnost“, čímž rozpoutal právní střet, který by mohl přetvořit způsob, jakým Washington kontroluje dodavatele umělé inteligence spolupracující s armádou.

Anthropic Daria Amodeie žaluje americkou vládu a tvrdí, že Pentagon se pomstil kvůli bezpečnostním zábradlím pro AI

Anthropic se v průlomové žalobě týkající se AI pouští do sporu s ministerstvem obrany

Podle několika zpráv podal Anthropic 9. března u federálního soudu dvě žaloby, v nichž zpochybňuje kroky amerického ministerstva obrany a Trumpovy administrativy. Tvrdí, že vláda se vůči společnosti nezákonně mstila poté, co odmítla odstranit ochranné pojistky ze svého systému umělé inteligence Claude. Žaloby se zaměřují na označení, které se obvykle vztahuje na zahraniční protivníky podezřelé ze špionáže či sabotáže, nikoli na domácí technologické firmy.

Spor má kořeny v jednáních o smlouvě mezi Anthropikem a Pentagonem ohledně toho, jak by mohl být model AI Claude používán americkými obrannými agenturami. Anthropic dříve podporoval iniciativy v oblasti národní bezpečnosti a v červnu 2024 se stal první „frontier“ AI společností, která nasadila modely na utajovaných sítích vlády USA, čímž pomáhala analytikům a vojenským plánovačům s vyhodnocováním zpravodajských informací, simulacemi, operačním plánováním a prací v oblasti kybernetické bezpečnosti.

Napětí eskalovalo, když ministerstvo obrany požadovalo v rámci obnovení kontraktu neomezený přístup ke Claude pro „všechny zákonné účely“. Anthropic souhlasil s většinou podmínek, ale trval na dvou omezeních: zakázat používání své AI k hromadnému domácímu sledování Američanů a zabránit nasazení v plně autonomních smrtících zbraňových systémech.

Vedení společnosti argumentovalo, že tyto mantinely jsou nezbytné, protože současné „frontier“ modely AI zůstávají pro autonomní zbraně příliš nespolehlivé a protože programy rozsáhlého sledování by mohly být v rozporu s ústavní ochranou. Anthropic uvedl, že omezení nikdy nezasahovala do žádné vojenské mise během předchozí spolupráce s vládou.

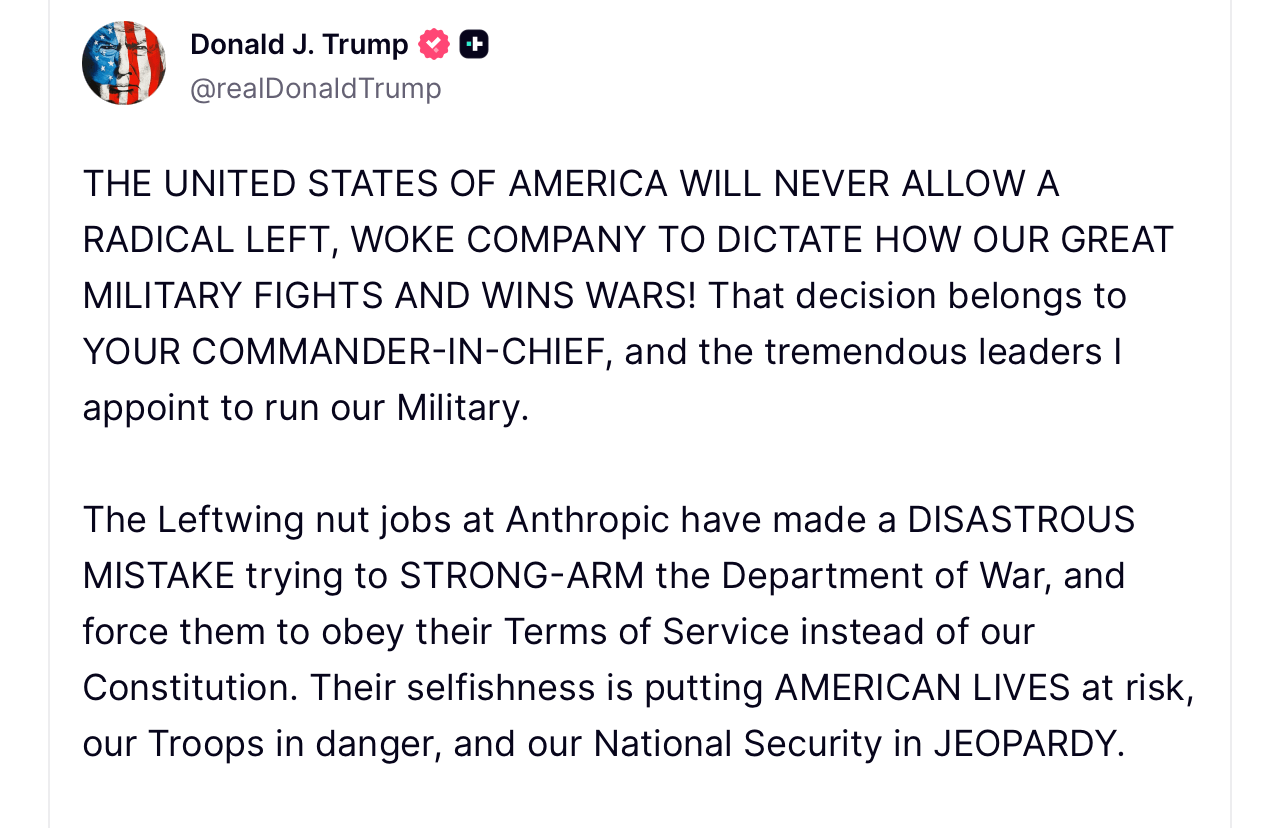

Jednání se zhroutila po schůzce z 24. února mezi generálním ředitelem Anthropiku Dariem Amodeiem a ministrem obrany Petem Hegsethem. O několik dní později, 27. února, prezident Donald Trump zveřejnil na Truth Social příspěvek, v němž federálním agenturám nařídil „okamžitě ukončit“ používání technologie Anthropiku a pokračující spoléhání na společnost označil za „katastrofální chybu“.

Krátce poté Hegseth přistoupil k tomu, aby byl Anthropic klasifikován jako riziko dodavatelského řetězce podle federální pravomoci v oblasti veřejných zakázek vymezené v 10 U.S.C. § 3252. Toto označení, potvrzené v dopise zaslaném společnosti přibližně 4. března, omezuje některým vládním dodavatelům používání technologií považovaných za zranitelné vůči sabotáži nebo zahraničnímu vlivu.

Anthropic tvrdí, že tento krok natahuje zákonné ustanovení daleko za zamýšlený účel. V soudních podáních společnost namítá, že označení bylo určeno pro bezpečnostní hrozby napojené na zahraničí, nikoli pro neshody o politice s domácími dodavateli. Žaloby uvádějí, že vláda nevyužila „nejméně omezující prostředky“, jak vyžaduje zákon, a místo toho uvalila to, co společnost popisuje jako neoficiální černou listinu.

Právní podání rovněž zmiňují ústavní obavy. Anthropic tvrdí, že označení porušuje První dodatek tím, že trestá společnost za veřejné prosazování limitů pro využití AI, jako jsou autonomní zbraně a domácí sledování. Podle žaloby označení firmy za riziko pro národní bezpečnost poškozuje její reputaci a mohlo by ohrozit kontrakty v hodnotě stovek milionů dolarů.

Anthropic žádá soudy, aby zablokovaly vymáhání tohoto označení, nařídily federálním agenturám stáhnout pokyny zastavující obchodní vztahy se společností a zabránily podobným krokům v budoucnu. Společnost uvedla, že jejím cílem není donutit vládu nakupovat její technologii, ale zabránit odvetě kvůli rozdílům v politice.

„Žádost o soudní přezkum nic nemění na našem dlouhodobém závazku využívat AI k ochraně naší národní bezpečnosti,“ uvedl mluvčí Anthropiku v prohlášení. „Je to však nezbytný krok k ochraně našeho podnikání, našich zákazníků a našich partnerů.“

Představitelé Pentagonu se k soudnímu sporu veřejně nevyjádřili s odkazem na politiku týkající se probíhajících soudních řízení. Někteří představitelé obrany již dříve argumentovali, že vojenské agentury si musí během mimořádných situací ponechat plnou operační pravomoc nad technologiemi dodavatelů a nemohou dopustit, aby dodavatelé určovali, jak se systémy používají.

Divoký víkend AI: Otřesy v OpenAI, střet s Pentagonem a roboti, kteří odmítají zemřít

Změny v oblasti AI přicházejí rychle: drama kolem OpenAI, střet Pentagonu s Anthropic, spuštění GPT-5.4, samoléčící se roboti a nové bezpečnostní nástroje. read more.

Přečíst

Divoký víkend AI: Otřesy v OpenAI, střet s Pentagonem a roboti, kteří odmítají zemřít

Změny v oblasti AI přicházejí rychle: drama kolem OpenAI, střet Pentagonu s Anthropic, spuštění GPT-5.4, samoléčící se roboti a nové bezpečnostní nástroje. read more.

Přečíst

Divoký víkend AI: Otřesy v OpenAI, střet s Pentagonem a roboti, kteří odmítají zemřít

PřečístZměny v oblasti AI přicházejí rychle: drama kolem OpenAI, střet Pentagonu s Anthropic, spuštění GPT-5.4, samoléčící se roboti a nové bezpečnostní nástroje. read more.

Spor přichází v době, kdy se zostřuje závod o zajištění vojenských kontraktů na AI. Konkurenční firmy, včetně OpenAI, uzavřely s Pentagonem dohody přibližně ve stejnou dobu, kdy se jednání s Anthropikem rozpadla. Mezitím hlavní technologičtí partneři, jako jsou Google a Microsoft, naznačili, že hodlají s Anthropikem pokračovat ve spolupráci na komerčních službách nesouvisejících s obranou.

Analytici z oboru říkají, že výsledek případu by mohl stanovit precedent pro to, jak federální vláda vyvíjí tlak na AI společnosti, aby upravily bezpečnostní politiky, když jsou ve hře zájmy národní bezpečnosti. Prozatím zůstávají spotřebitelské produkty Anthropiku a komerční služby AI dostupné, zatímco právní bitva o označení Pentagonu začíná procházet soudy.

FAQ 🧭

- Proč Anthropic zažaloval vládu USA?

Anthropic podal žaloby s tvrzením, že Pentagon nezákonně označil společnost za riziko dodavatelského řetězce pro národní bezpečnost poté, co odmítla odstranit bezpečnostní omezení AI. - Co vyvolalo spor mezi Anthropikem a Pentagonem?

Konflikt začal během jednání o smlouvě, když ministerstvo obrany požadovalo neomezené používání AI systému Claude od Anthropiku. - Co znamená označení „riziko dodavatelského řetězce“?

Toto označení může omezit vládním dodavatelům používání technologie určité společnosti, pokud se úředníci domnívají, že představuje bezpečnostní nebo nákupní rizika. - Budou služby AI Anthropiku během soudního sporu stále fungovat?

Ano, komerční AI produkty Anthropiku a spotřebitelské služby zůstávají dostupné, zatímco právní řízení pokračuje.