التقى وزير الدفاع بيت هيغسيث بالرئيس التنفيذي لشركة أنثروبيك داريو أمودي في البنتاغون يوم الثلاثاء، في وقت كانت فيه وزارة الدفاع تضغط على أنثروبيك لإزالة القيود المفروضة على نظام الذكاء الاصطناعي (AI) «كلود» أو مواجهة عقوبات محتملة.

تقرير: يواجه «كلود» من أنثروبيك مستقبلًا غير مؤكد في أنظمة البنتاغون المصنّفة السرية

اختبار حوكمة الذكاء الاصطناعي العسكري في اجتماع عالي المخاطر داخل البنتاغون

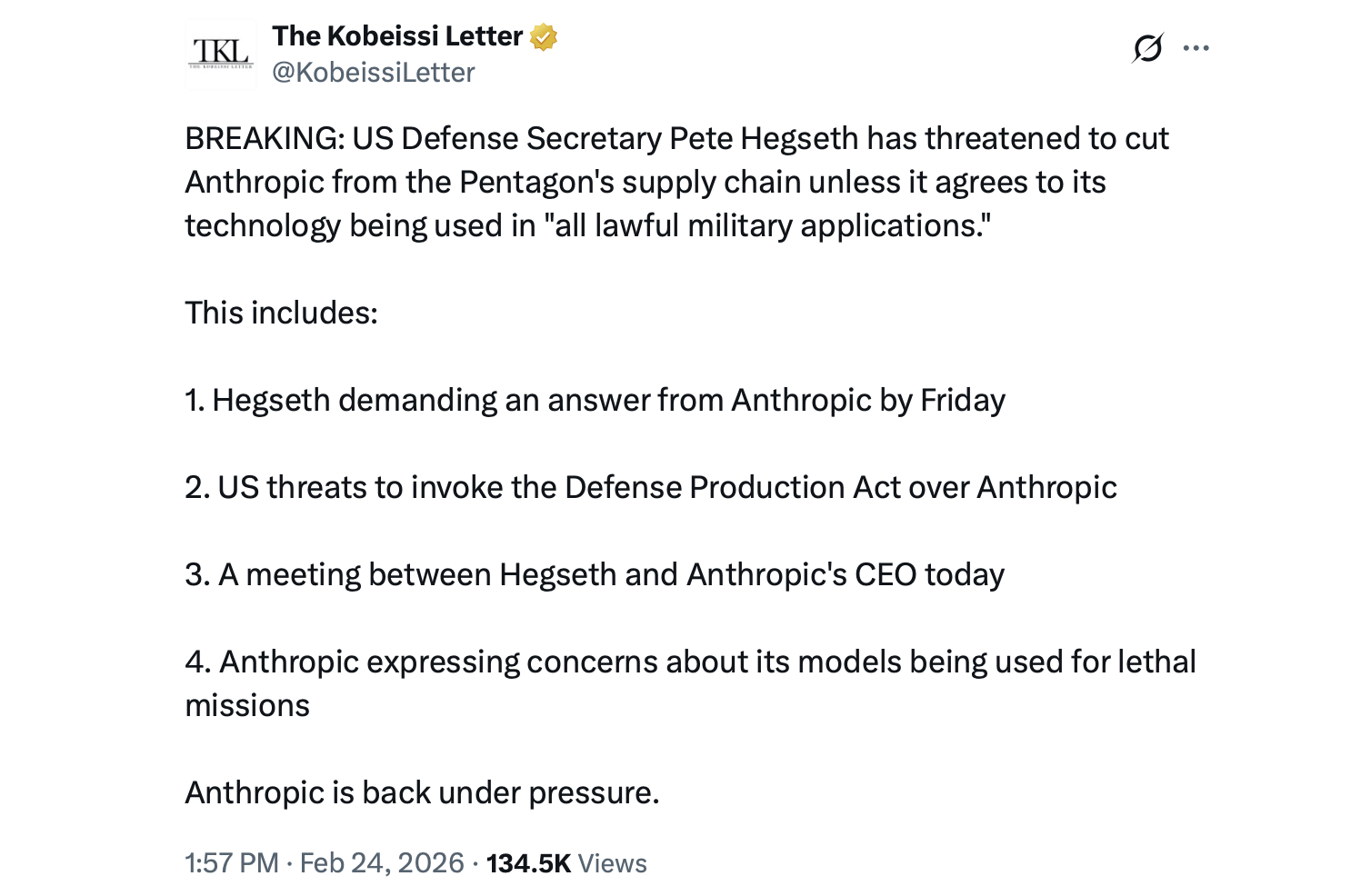

أعقب اجتماع 24 فبراير أسابيع من التوتر بشأن سياسات استخدام أنثروبيك لنظام «كلود»، وهو نموذج لغوي كبير مُدمج ضمن شبكات وزارة الدفاع المصنّفة سرّية بموجب عقد تجريبي لعام 2025 تصل قيمته إلى 200 مليون دولار. ويُعد «كلود» حالياً نموذج اللغة الكبير الوحيد المُصرّح به بالكامل للعمل عبر بعض الأنظمة الآمنة في البنتاغون.

وفقاً لتقرير Axios reporting، اعترض هيغسيث، وبمشاركة نائب الوزير ستيف فاينبرغ والمستشار العام إيرل ماثيوز، على قيود أنثروبيك بشأن المراقبة الجماعية للأميركيين وبشأن أنظمة الأسلحة ذاتية التشغيل بالكامل التي تعمل من دون إشراف بشري. وجادل مسؤولو الدفاع بأن تلك الحدود تقيد تطبيقات عسكرية قانونية ويجب ألا تتغلب على السلطة التشريعية والتنفيذية.

وأكدت أنثروبيك أن ضوابطها صُممت لمنع سوء الاستخدام مع الاستمرار في تمكين تطبيقات الأمن القومي. وتقول الشركة إن سياساتها لا تمنع الاستخدام العسكري المشروع، لكنها تحظر أنشطة مثل تتبع الأفراد من دون موافقة أو نشر أنظمة فتاكة من دون تحكم بشري.

ونقلت مراسلة فوكس نيوز الرئيسية لشؤون الأمن القومي جينيفر غريفين reported على منصة X: «وفقاً لمصدر مطّلع على المحادثات، لم تعترض أنثروبيك قط على استخدام نماذجها في “العمليات العسكرية المشروعة”». وأضافت: «كما أبلغت هيغسيث أنها لم تشكُ أبداً إلى البنتاغون أو بالانتير بشأن استخدام نماذجها في غارة مادورو».

وقد استُخدم «كلود» في تحليل الاستخبارات والدفاع السيبراني والتخطيط العملياتي. وتشير تقارير إلى أنه دعم التخطيط والتحليل في الوقت الحقيقي خلال عملية 3 يناير التي أسفرت عن القبض على الرئيس الفنزويلي نيكولاس مادورو. ولاحقاً سعت أنثروبيك إلى توضيح بشأن دور النموذج في ذلك ضمن مراجعة امتثال داخلية، وهو ما فسّره مسؤولو البنتاغون على أنه انتقاد.

في 9 يناير، أصدر هيغسيث مذكرة تحث مزودي الذكاء الاصطناعي (AI) على إزالة ما وصفه بالشروط المقيّدة. وقد مهّد ذلك التوجيه الطريق لإعادة التفاوض وفي نهاية المطاف لاجتماع 24 فبراير.

وقد حدّد البنتاغون موعداً نهائياً في 27 فبراير أمام أنثروبيك لتعديل شروطها. وتشمل الردود المحتملة تفعيل قانون الإنتاج الدفاعي لإجبار الامتثال أو تصنيف أنثروبيك بوصفها خطراً على سلسلة الإمداد، وهي خطوة قد تتطلب من المتعاقدين التخارج من الأنظمة المرتبطة بـ«كلود».

ويقر المسؤولون بأن فصل «كلود» عن البنية التحتية القائمة سيكون معقداً من الناحية التشغيلية. ومع ذلك، لدى الوزارة بدائل. فالمنافسون مثل xAI بنموذج Grok، وOpenAI مع ChatGPT، وغوغل مع Gemini، يخضعون لعقود مماثلة مع وزارة الدفاع وقد يكونون في وضع يسمح لهم بتوسيع أدوارهم إذا تعثرت المحادثات.

ويُبرز النزاع أسئلة أوسع حول حوكمة الذكاء الاصطناعي في البيئات العسكرية، لا سيما مع استمرار تطور القانون الفيدرالي حول التقنيات الناشئة. وما هو على المحك هو ما إذا كان مطورو الذكاء الاصطناعي في القطاع الخاص يمكنهم الحفاظ على سياسات أخلاقية مستقلة عندما تصبح أنظمتهم جزءاً مدمجاً في عمليات الأمن القومي.

وجاءت ردود الفعل عبر منصات التواصل الاجتماعي صريحة بشكل ملحوظ. «عادت المراقبة من دون مذكرة قضائية»، كتب أحد مستخدمي X wrote رداً على منشور غريفين على X. «يجب أن يكون هذا خبراً أكبر بكثير مما هو عليه. هناك احتمال جدي لحدوث انتهاكات دستورية»، ردّ آخر replied على ما كتبته غريفين. وآخرون، بلمسة من الدعابة السوداء، joked بأن وصول «سكاي نت» قد لا يكون بعيداً. وعلّق أحدهم: «سكاي نت هنا… جدول 2029 الزمني أصبح سارياً».

ووصف الطرفان نقاش 24 فبراير بأنه جوهري. وقد يحدد ما إذا كانت أنثروبيك ستعدّل ضوابطها قبل الموعد النهائي مستقبلَ أحد أكثر تكاملات الذكاء الاصطناعي تقدماً لدى البنتاغون.

الأسئلة الشائعة 🤖

- ما الذي نوقش في اجتماع البنتاغون يوم 24 فبراير؟

تركّز الاجتماع على قيود أنثروبيك على «كلود» وما إذا كانت تحدّ من التطبيقات العسكرية القانونية. - لماذا يضغط البنتاغون على أنثروبيك؟

يجادل مسؤولو الدفاع بأن ضوابط الشركة تتداخل مع استخدامات الأمن القومي المصرح بها. - ماذا يمكن أن يحدث إذا لم تمتثل أنثروبيك؟

قد يُفعّل البنتاغون قانون الإنتاج الدفاعي أو يُصنّف الشركة على أنها خطر على سلسلة الإمداد. - هل توجد بدائل لـ«كلود»؟

نعم، فالنماذج من xAI وOpenAI وغوغل تخضع لعقود مع وزارة الدفاع وقد تتوسع إذا دعت الحاجة.