اتخذت شركة أنثروبيك خطوة استثنائية برفع دعوى قضائية ضد الحكومة الأميركية بعد أن صنّفها البنتاغون شركة الذكاء الاصطناعي (AI) على أنها «مخاطر على سلسلة الإمداد للأمن القومي»، مما أشعل مواجهة قانونية قد تعيد تشكيل الطريقة التي تتحكم بها واشنطن في مورّدي الذكاء الاصطناعي العاملين مع الجيش.

أنثروبيك التابعة لداريو أموداي تقاضي الحكومة الأمريكية، قائلة إن البنتاغون انتقم بسبب ضوابط أمان الذكاء الاصطناعي

أنثروبيك تواجه وزارة الدفاع في دعوى تاريخية حول الذكاء الاصطناعي

وفقًا لـعدة تقارير، رفعت أنثروبيك دعويين قضائيتين في 9 مارس أمام محكمة فيدرالية تطعن فيهما في إجراءات اتخذتها وزارة الدفاع الأميركية وإدارة ترامب، مجادلة بأن الحكومة انتقمت من الشركة بشكل غير قانوني بعدما رفضت إزالة ضمانات الأمان من نظامها للذكاء الاصطناعي «كلود». وتستهدف الدعاوى تصنيفًا يُطبَّق عادة على خصوم أجانب يُشتبه في قيامهم بالتجسس أو التخريب، وليس على شركات تكنولوجيا محلية.

يعود النزاع إلى مفاوضات عقود بين أنثروبيك والبنتاغون بشأن كيفية استخدام نموذج الذكاء الاصطناعي «كلود» من قبل وكالات الدفاع الأميركية. وكانت أنثروبيك قد دعمت سابقًا مبادرات الأمن القومي، وأصبحت أول شركة في طليعة الذكاء الاصطناعي تنشر نماذجها على شبكات حكومية أميركية مصنّفة سرية في يونيو 2024، لمساعدة المحللين والمخططين العسكريين في مراجعة المعلومات الاستخباراتية، والمحاكاة، والتخطيط العملياتي، وأعمال الأمن السيبراني.

تصاعدت التوترات عندما طالبت وزارة الدفاع بإتاحة وصول غير مقيّد إلى «كلود» لـ«جميع الأغراض القانونية» كجزء من تجديد العقد. وافقت أنثروبيك على معظم الشروط لكنها أصرت على قيدين: حظر استخدام ذكائها الاصطناعي للمراقبة المحلية الجماعية للأميركيين، ومنع نشره ضمن أنظمة أسلحة قاتلة ذاتية التشغيل بالكامل.

وجادل مسؤولو الشركة بأن تلك الضوابط ضرورية لأن نماذج الذكاء الاصطناعي المتقدمة الحالية لا تزال غير موثوقة بما يكفي للأسلحة ذاتية التشغيل، ولأن برامج المراقبة واسعة النطاق قد تتعارض مع الحمايات الدستورية. وقالت أنثروبيك إن القيود لم تعرقل أي مهمة عسكرية خلال عملها السابق مع الحكومة.

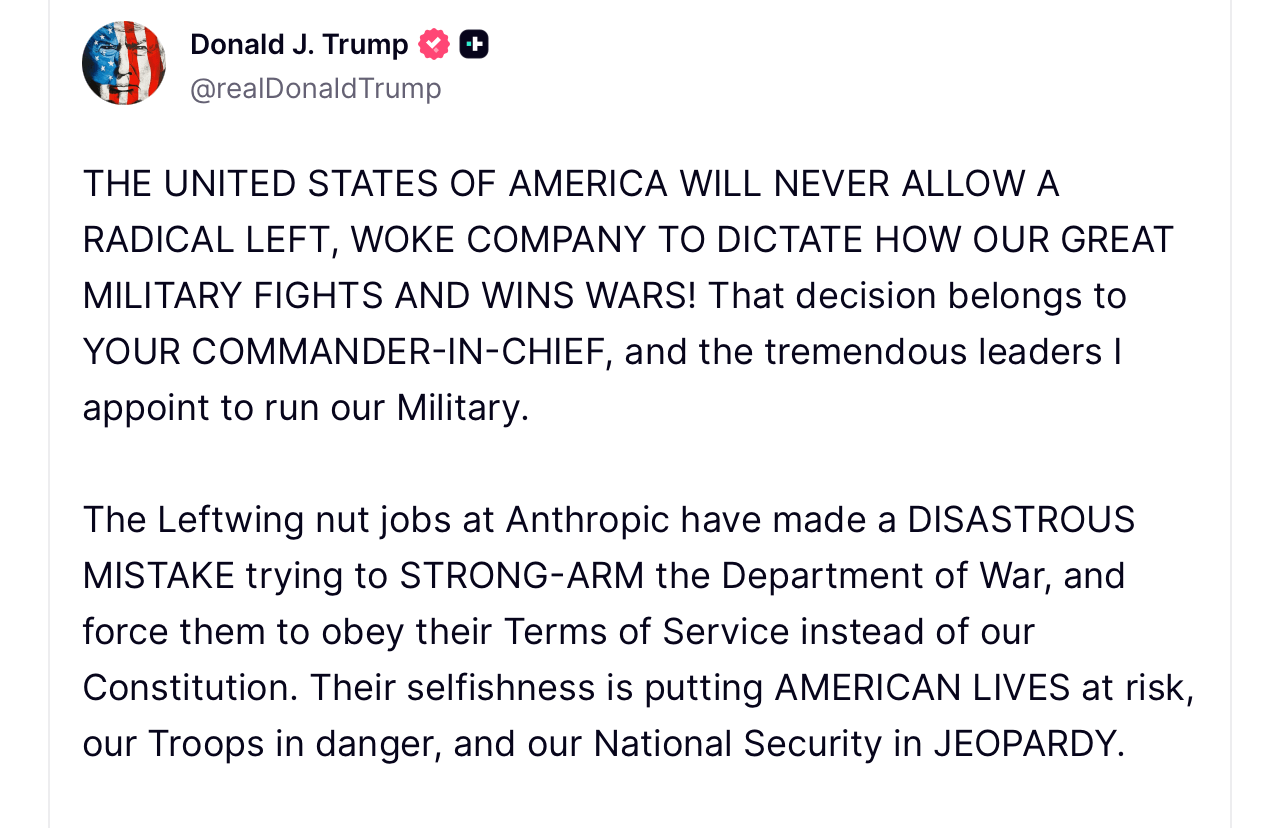

انهارت المفاوضات عقب اجتماع في 24 فبراير بين الرئيس التنفيذي لأنثروبيك داريو أمودي ووزير الدفاع بيت هيغسيث. وبعد أيام، في 27 فبراير، نشر الرئيس دونالد ترامب على منصة تروث سوشيال منشورًا يوجّه فيه الوكالات الفيدرالية إلى «التوقف فورًا» عن استخدام تقنية أنثروبيك، واصفًا استمرار الاعتماد على الشركة بأنه «خطأ كارثي».

وبعد ذلك بوقت قصير، تحرّك هيغسيث لتصنيف أنثروبيك على أنها مخاطر على سلسلة الإمداد بموجب سلطة المشتريات الفيدرالية الموضحة في 10 U.S.C. § 3252. ويقيّد هذا التصنيف، الذي تأكد في رسالة أُرسلت إلى الشركة قرابة 4 مارس، بعض المتعاقدين الحكوميين من استخدام التكنولوجيا التي تُعد عرضة للتخريب أو للتأثير الأجنبي.

وتقول أنثروبيك إن هذه الخطوة توسّع نطاق القانون إلى ما يتجاوز بكثير الغرض المقصود منه. وفي المذكرات المقدمة للمحكمة، تجادل الشركة بأن التصنيف وُضع لمواجهة تهديدات أمنية مرتبطة بجهات أجنبية، وليس لخلافات سياسية مع مورّدين محليين. وتزعم الدعاوى أن الحكومة لم تستخدم «أقل الوسائل تقييدًا» التي يتطلبها القانون، وبدلًا من ذلك فرضت ما تصفه الشركة بأنه قائمة حظر غير رسمية.

وتثير المذكرات القانونية أيضًا مخاوف دستورية. إذ تقول أنثروبيك إن التصنيف ينتهك التعديل الأول عبر معاقبة الشركة بسبب دفاعها علنًا عن وضع حدود لاستخدامات الذكاء الاصطناعي مثل الأسلحة ذاتية التشغيل والمراقبة المحلية. ووفقًا للشكوى، فإن وصف الشركة بأنها خطر على الأمن القومي يضر بسمعتها وقد يهدد عقودًا بمئات الملايين من الدولارات.

وتطلب أنثروبيك من المحاكم منع تنفيذ التصنيف، وإلزام الوكالات الفيدرالية بسحب التوجيهات التي توقف التعامل مع الشركة، ومنع اتخاذ إجراءات مماثلة مستقبلًا. وقالت الشركة إن هدفها ليس إجبار الحكومة على شراء تقنيتها، بل منع الانتقام بسبب اختلافات سياسية.

وقال متحدث باسم أنثروبيك في بيان نقلته: «إن السعي إلى مراجعة قضائية لا يغيّر التزامنا الراسخ بتسخير الذكاء الاصطناعي لحماية أمننا القومي». وأضاف: «لكنها خطوة ضرورية لحماية أعمالنا وعملائنا وشركائنا».

ولم يعلّق مسؤولو البنتاغون علنًا على التقاضي، مستشهدين بالسياسة المتبعة بشأن القضايا المنظورة أمام المحاكم. وكان بعض قادة الدفاع قد جادلوا سابقًا بأن الوكالات العسكرية يجب أن تحتفظ بكامل السلطة التشغيلية على تقنيات المتعاقدين خلال حالات الطوارئ، ولا يمكنها السماح للمورّدين بإملاء كيفية استخدام الأنظمة.

عطلة نهاية أسبوع جامحة للذكاء الاصطناعي: هزة في OpenAI، صدام مع البنتاغون، وروبوتات ترفض أن تموت

التغييرات المفاجئة في الذكاء الاصطناعي تتسارع: دراما OpenAI، صدام البنتاغون مع Anthropic، إطلاق GPT-5.4، روبوتات ذاتية الشفاء وأدوات أمنية جديدة. read more.

اقرأ الآن

عطلة نهاية أسبوع جامحة للذكاء الاصطناعي: هزة في OpenAI، صدام مع البنتاغون، وروبوتات ترفض أن تموت

التغييرات المفاجئة في الذكاء الاصطناعي تتسارع: دراما OpenAI، صدام البنتاغون مع Anthropic، إطلاق GPT-5.4، روبوتات ذاتية الشفاء وأدوات أمنية جديدة. read more.

اقرأ الآن

عطلة نهاية أسبوع جامحة للذكاء الاصطناعي: هزة في OpenAI، صدام مع البنتاغون، وروبوتات ترفض أن تموت

اقرأ الآنالتغييرات المفاجئة في الذكاء الاصطناعي تتسارع: دراما OpenAI، صدام البنتاغون مع Anthropic، إطلاق GPT-5.4، روبوتات ذاتية الشفاء وأدوات أمنية جديدة. read more.

يأتي هذا النزاع في وقت تحتدم فيه المنافسة على الفوز بعقود الذكاء الاصطناعي العسكرية. وقد توصلت شركات منافسة، بما في ذلك OpenAI، إلى اتفاقات مع البنتاغون في الفترة نفسها تقريبًا التي تعثرت فيها مفاوضات أنثروبيك. وفي الوقت نفسه، أشارت شركات تقنية كبرى شريكة مثل Google وMicrosoft إلى أنها تنوي مواصلة العمل مع أنثروبيك على خدمات تجارية غير مرتبطة بالدفاع.

ويقول محللو الصناعة إن نتيجة القضية قد ترسي سابقة لكيفية ضغط الحكومة الفيدرالية على شركات الذكاء الاصطناعي لتعديل سياسات السلامة عندما تكون مصالح الأمن القومي على المحك. وحتى الآن، لا تزال منتجات أنثروبيك الاستهلاكية وخدمات الذكاء الاصطناعي التجارية متاحة، بينما تبدأ المعركة القانونية حول تصنيف البنتاغون في شق طريقها عبر المحاكم.

الأسئلة الشائعة 🧭

- لماذا رفعت أنثروبيك دعوى ضد الحكومة الأميركية؟

رفعت أنثروبيك دعاوى تزعم فيها أن البنتاغون صنّف الشركة بشكل غير قانوني على أنها مخاطر على سلسلة الإمداد للأمن القومي بعدما رفضت إزالة قيود سلامة الذكاء الاصطناعي. - ما الذي أشعل النزاع بين أنثروبيك والبنتاغون؟

بدأ الخلاف خلال مفاوضات العقود عندما طالبت وزارة الدفاع باستخدام غير مقيّد لنظام الذكاء الاصطناعي «كلود» الخاص بأنثروبيك. - ماذا يعني تصنيف «مخاطر سلسلة الإمداد»؟

يمكن أن يحدّ هذا التصنيف من استخدام المتعاقدين الحكوميين لتقنية شركة ما إذا اعتقد المسؤولون أنها تشكل مخاطر أمنية أو مخاطر على المشتريات. - هل ستستمر خدمات الذكاء الاصطناعي لدى أنثروبيك في العمل أثناء الدعوى؟

نعم، تظل منتجات أنثروبيك التجارية للذكاء الاصطناعي وخدماتها الاستهلاكية متاحة بينما تمضي القضية القانونية قدمًا.